Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

As inteligências artificiais atuais são altamente eficientes em tarefas específicas. Uma AGI seria capaz de aprender qualquer habilidade intelectual, transferir conhecimento entre áreas diferentes e resolver problemas inéditos sem treinamento dedicado, aproximando-se da flexibilidade cognitiva humana.

AGI (Artificial General Intelligence), ou inteligência artificial geral, é um sistema de IA capaz de realizar qualquer tarefa intelectual que um ser humano consegue executar — aprendendo, raciocínando e se adaptando de forma autônoma em contextos completamente novos, sem precisar de treinamento específico para cada situação.

AGI o que é? A inteligência artificial geral (AGI) é um tipo de IA capaz de realizar qualquer tarefa intelectual humana, aprendendo, raciocinando e se adaptando de forma autônoma.

Se a AGI realmente for criada, ela pode se tornar a tecnologia mais importante da história — mais impactante que a internet, os smartphones e até a eletricidade.

Em três pontos:

Hoje, a AGI não existe. O que temos são sistemas de IA estreita (ANI) — extraordinariamente capazes em tarefas específicas, mas sem a flexibilidade generalista que define a AGI.

📩 Quer entender o futuro da IA antes do mercado? A newsletter do SPTechBR analisa toda semana o que realmente importa em inteligência artificial — sem hype, sem enrolação.

Em janeiro de 2026, três dos CEOs mais importantes da IA global disseram, na mesma semana, coisas completamente contraditórias sobre o mesmo tema:

Se os maiores especialistas do planeta não concordam sobre o que é AGI, quando chega ou se já existe — o que você precisa saber para não ficar pra trás?

É exatamente isso que este guia responde.

A inteligência artificial geral é frequentemente descrita como o “Santo Graal” da IA — o ponto em que máquinas deixam de ser ferramentas especializadas e se tornam inteligências verdadeiramente versáteis.

Para ser classificada como AGI, um sistema precisaria:

Aqui está o ponto que a maioria dos artigos ignora: não existe uma definição única e universal de AGI.

Cada laboratório usa critérios diferentes:

Essa divergência não é semântica. Ela explica por que as previsões de timeline vão de “já chegamos lá” a “décadas ainda”.

A dificuldade de definir AGI também está ligada à velocidade com que os modelos atuais evoluem. Um exemplo recente é o avanço dos modelos chineses de código aberto, que passaram a competir diretamente com os líderes ocidentais. Esse movimento é analisado em DeepSeek V4: a IA chinesa que quer desafiar o Vale do Silício.

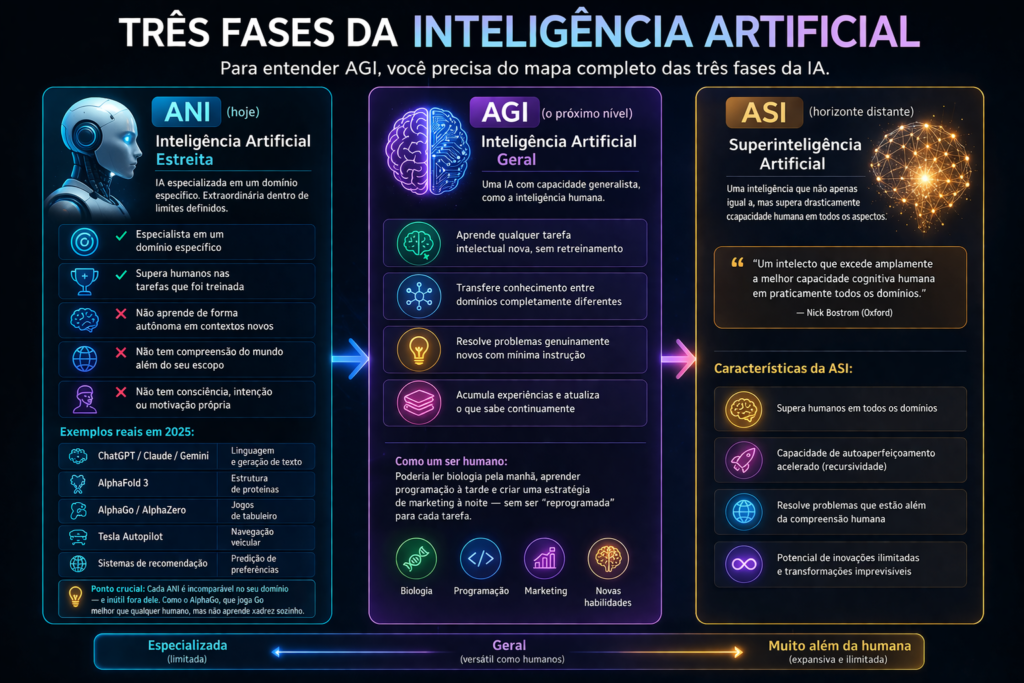

Para entender AGI, você precisa do mapa completo das três fases da IA.

A IA que existe em 2025 é chamada de ANI (Artificial Narrow Intelligence) — e ela é extraordinariamente capaz dentro de limites definidos.

Características da ANI:

Exemplos reais de ANI em 2025:

| Sistema | Especialidade |

|---|---|

| ChatGPT / Claude / Gemini | Linguagem e geração de texto |

| AlphaFold 3 | Estrutura de proteínas |

| AlphaGo / AlphaZero | Jogos de tabuleiro |

| Tesla Autopilot | Navegação veicular |

| Sistemas de recomendação | Predição de preferências |

🔑 O ponto crucial: O AlphaGo joga Go melhor do que qualquer humano da história. Mas não consegue aprender xadrez sozinho. Cada ANI é incomparável no seu domínio — e inútil fora dele.

O que a AGI representaria:

A analogia mais clara: uma AGI poderia ler um artigo de biologia pela manhã, aprender programação à tarde e criar uma estratégia de marketing à noite — sem ser “reprogramada” para cada tarefa. Exatamente como um ser humano inteligente faz.

A ASI (Artificial Superintelligence) é o estágio hipotético além da AGI: uma inteligência que não apenas iguala, mas supera drasticamente a capacidade humana em todos os aspectos.

O filósofo Nick Bostrom, de Oxford, define ASI como “um intelecto que excede amplamente os melhores cérebros humanos em criatividade científica, sabedoria geral e habilidades sociais”.

| ANI | AGI | ASI | |

|---|---|---|---|

| Status | ✅ Existe | ⏳ Não existe | 🔮 Hipotética |

| Capacidade | Específica | Generalista | Superior em tudo |

| Aprende autonomamente? | Não | Sim | Sim + auto-melhoria |

| Exemplo | ChatGPT, AlphaFold | — | — |

| Risco principal | Baixo-médio | Alto | Existencial |

Resposta direta: não.

Mas a resposta honesta é mais nuançada.

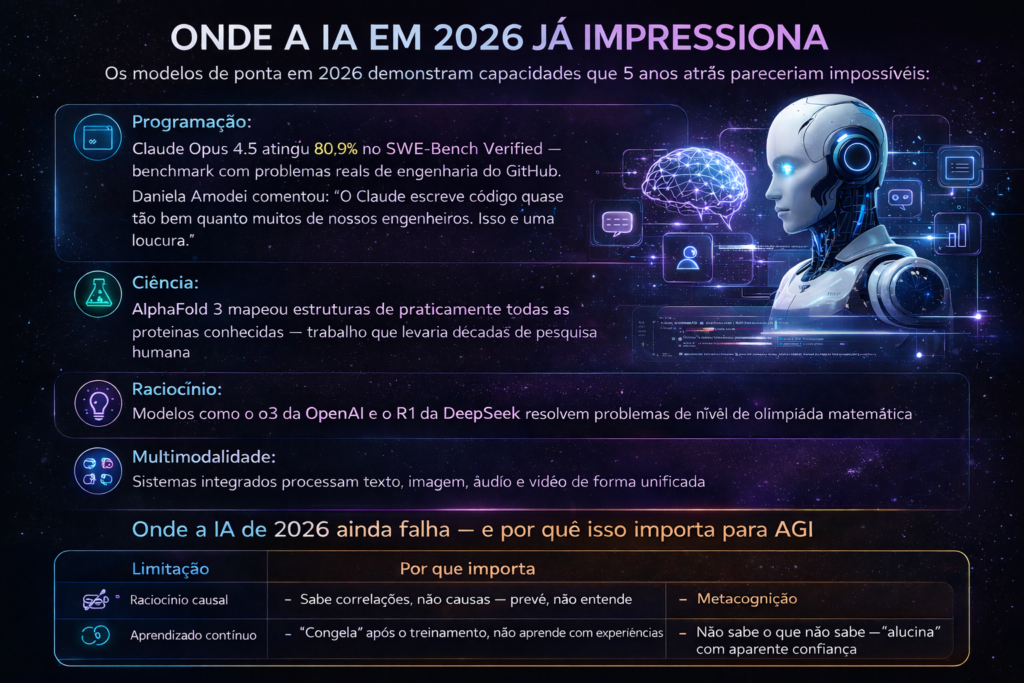

Os modelos de ponta em 2026 demonstram capacidades que 5 anos atrás pareceriam impossíveis:

📊 Dados concretos de performance:

Apesar dos avanços, existem limitações fundamentais que ainda separam os sistemas atuais da AGI:

| Limitação | Por que importa |

|---|---|

| Raciocínio causal | Sabe correlações, não causas — prevê, não entende |

| Aprendizado contínuo | “Congela” após o treinamento, não aprende com experiências |

| Senso comum | Falha em situações que qualquer criança de 5 anos resolve |

| Generalização zero-shot | Transferência real para domínios completamente novos ainda falha |

| Metacognição | Não sabe o que não sabe — “alucina” com aparente confiança |

💡 Onde estamos na escala em 2025: na transição entre ANI avançada e o que pesquisadores chamam de “Broad AI” — sistemas com capacidades generalistas em muitos domínios, mas sem a flexibilidade completa da AGI real.

| Player | País | Destaque |

|---|---|---|

| xAI (Elon Musk) | EUA | Modelo Grok, previsão AGI 2026-2027 |

| Meta AI | EUA | LLaMA open source, democratização do acesso |

| DeepSeek | China | Chocou o mundo em jan/2025 com desempenho de ponta a baixo custo |

| Baidu, Alibaba, ByteDance | China | Investimento estatal massivo |

A disputa pela AGI não é apenas tecnológica. Ela envolve interesses econômicos, estratégicos e geopolíticos cada vez mais relevantes. Entenda esse cenário em A Guerra Fria da Inteligência Artificial: como EUA, China e Europa disputam o poder tecnológico do século XXI.

A corrida pela AGI não é apenas uma disputa de talento ou pesquisa. Ela também é uma das maiores corridas por infraestrutura da história da tecnologia.

Diferentemente de revoluções digitais anteriores, construir modelos de inteligência artificial avançada exige investimentos massivos em poder computacional, energia elétrica, armazenamento de dados e engenharia especializada.

Em muitos aspectos, a corrida pela AGI está se tornando uma corrida por capacidade industrial.

Treinar modelos de fronteira exige dezenas de milhares de GPUs operando simultaneamente durante semanas ou meses.

Empresas como OpenAI, Google DeepMind e Anthropic investem bilhões de dólares por ano apenas em infraestrutura computacional.

O treinamento de um único modelo avançado pode custar centenas de milhões de dólares quando se consideram:

À medida que os modelos crescem, cresce também a necessidade de energia.

Alguns analistas já apontam que a disponibilidade energética pode se tornar um dos principais limitadores da evolução da IA.

Datacenters modernos consomem quantidades de eletricidade comparáveis às de cidades inteiras.

Por isso, a corrida pela AGI não envolve apenas laboratórios de IA. Ela também envolve empresas de energia, fabricantes de chips e operadores de infraestrutura.

Durante décadas, o petróleo foi considerado o recurso estratégico mais importante da economia global.

Na era da IA, três recursos disputam esse papel:

Quem controlar esses ativos terá vantagem significativa na construção dos sistemas mais avançados das próximas décadas.

Esse cenário ajuda a explicar por que governos e empresas estão investindo bilhões de dólares para garantir acesso a chips, datacenters e infraestrutura crítica.

Esta pode ser a parte mais honesta deste guia: os maiores especialistas do mundo não concordam.

Sam Altman (OpenAI):

“Estamos confiantes de que sabemos como construir AGI.” (jan/2025) Previsão: AGI durante o mandato Trump (antes de 2029)

Dario Amodei (Anthropic):

“Em dois a três anos, veremos modelos melhores que humanos em quase tudo.” Previsão baseada em extrapolação linear: 2026-2027

Jeetu Patel (Cisco, Diretor de Produtos):

“Veremos sinais tangíveis de AGI já em 2025.”

Demis Hassabis (Google DeepMind):

“A AGI está provavelmente a alguns anos de distância.” Estimativa: 3 a 5 anos — mas com ressalva de que os sistemas atuais ainda são “muito passivos”

Daniela Amodei (Anthropic, presidente):

“AGI é um conceito ultrapassado. Por algumas definições, já chegamos lá.” Ponto de vista: a pergunta errada — o que importa é o que os sistemas fazem, não definições teóricas

Andrew Ng (fundador do Google Brain): AGI está “a muitas décadas de distância, talvez mais”. LLMs não são o caminho para AGI.

Gary Marcus (NYU): Modelos atuais falham em situações que crianças de 8 anos resolvem. AGI exige descobertas científicas fundamentais ainda não feitas.

Robin Li (Baidu): AGI está a mais de uma década. O otimismo dos laboratórios americanos é parcialmente estratégia de marketing para investidores.

A divergência entre especialistas não é fraqueza — é honestidade. A AGI não é um ponto no tempo: é um espectro. Dependendo de onde você traça a linha, ela já existe em alguns domínios, está prestes a chegar em outros, ou ainda está distante.

O consenso real: a velocidade atual de progresso é sem precedentes — e o impacto, quando vier, será transformador.

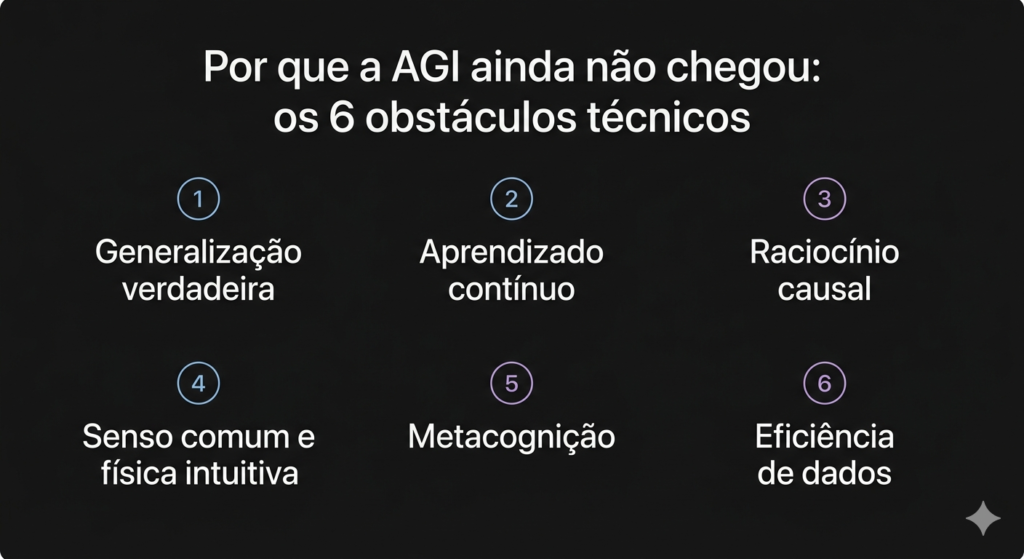

Se AGI fosse só uma questão de escalar os modelos atuais, já teríamos chegado lá. Os problemas restantes são fundamentais.

Curiosamente, algumas das limitações mais conhecidas dos modelos atuais já aparecem no uso cotidiano de ferramentas populares. Um dos exemplos mais importantes são as chamadas alucinações de IA, tema explorado em Hallucinations em IA: por que ChatGPT e outros modelos inventam respostas.

O problema: modelos atuais são treinados em trilhões de exemplos e se saem bem em tarefas parecidas com o treinamento. Mas em situações genuinamente novas — sem exemplos similares — falham de formas surpreendentes.

O que AGI precisaria: generalizar como humanos fazem — a partir de pouquíssimos exemplos, para situações completamente inéditas (zero-shot generalization).

O problema: modelos atuais aprendem durante o treinamento e depois “congelam”. Não atualizam seu conhecimento com novas experiências sem ser retreinados.

O que AGI precisaria: aprender continuamente — como humanos fazem, sem “esquecer catastroficamente” o que sabia antes.

O problema: IA atual detecta correlações, não causas. Ela prevê o próximo token — não entende por que as coisas acontecem.

Exemplo: um modelo sabe que guarda-chuvas são vendidos em dias chuvosos. Mas não entende que as pessoas compram guarda-chuva porque vai chover — não o contrário.

O que AGI precisaria: raciocínio causal genuíno. Entender mecanismos, não apenas padrões.

O problema: qualquer criança de 5 anos sabe que objetos sólidos não atravessam paredes, que água cai para baixo, que se você soltar algo ele cai. Modelos de linguagem treinados em texto nunca “viram” o mundo físico — só leram sobre ele.

O que AGI precisaria: compreensão intuitiva do mundo físico e social, não apenas representações linguísticas.

O problema: modelos atuais frequentemente “alucinam” — geram informações incorretas com aparente confiança, sem sinalizar a incerteza.

O que AGI precisaria: saber o que não sabe. Reconhecer limitações. Pedir ajuda quando necessário.

O problema: GPT-4 foi treinado em aproximadamente 1 trilhão de tokens. Uma criança aprende o conceito de “cachorro” a partir de alguns exemplos — não de bilhões de fotos rotuladas.

O que AGI precisaria: aprendizado muito mais eficiente. Ou descobrir como extrair mais conhecimento de menos dados — como os humanos fazem naturalmente.

Muitos pesquisadores acreditam que a transição para sistemas mais gerais acontecerá gradualmente por meio de agentes cada vez mais autônomos. Essa evolução é analisada em O que são agentes de IA e como eles podem transformar a internet.

Com AGI:

O AlphaFold 3 já mapeou estruturas de praticamente todas as proteínas conhecidas — o que levaria décadas de laboratório. Uma AGI aplicada a ciências da vida poderia multiplicar esse impacto exponencialmente.

Com AGI:

Com AGI:

Com AGI:

💡 Nota editorial: existem dois tipos de conversa sobre riscos de AGI — o catastrofismo de ficção científica (Skynet, robôs assassinos) e os riscos documentados por pesquisadores sérios. Este guia foca nos segundos.

O problema: como garantir que um sistema de AGI extraordinariamente capaz vai buscar objetivos que são bons para humanos?

Não é que a IA vai “querer” nos destruir. É que um sistema poderoso otimizando para o objetivo errado — ou uma versão incompleta do objetivo certo — pode causar danos massivos sem nenhuma intenção maliciosa.

A Anthropic foi fundada exatamente para trabalhar nesse problema. Sua abordagem de “Constitutional AI” é uma tentativa prática de construir sistemas que persigam objetivos corretos.

Quem controla a AGI controla uma vantagem competitiva sem precedentes históricos.

Se uma única empresa, governo ou grupo tiver acesso exclusivo a uma AGI funcional antes que outros tenham qualquer resposta, o desequilíbrio de poder seria catastrófico para a democracia global.

O cenário mais preocupante: a própria IA começa a acelerar seu desenvolvimento.

Uma AGI que pode escrever código e propor melhorias para sua própria arquitetura poderia criar um ciclo de auto-aperfeiçoamento que vai além da capacidade humana de monitorar e controlar.

O relatório AI 2027 (ex-pesquisadores da OpenAI) traça um cenário plausível onde isso acontece em 2027 — com consequências imprevisíveis.

Com sistemas de linguagem cada vez mais capazes, a produção de desinformação persuasiva, deep fakes e campanhas de manipulação pode escalar para dimensões que nenhuma sociedade está preparada para lidar.

Quanto mais integrada em infraestrutura crítica (energia, financeiro, saúde, defesa), mais um mal funcionamento de AGI pode ter consequências catastróficas.

Esta é a parte que mais pessoas querem saber. A resposta honesta: sabemos mais do que o senso comum pensa — e menos do que as manchetes sugerem.

O impacto da inteligência artificial sobre profissões já pode ser observado muito antes da chegada de uma AGI completa. Um dos sinais mais claros é o surgimento de novas ocupações especializadas, analisadas em As novas profissões criadas pela IA já começaram a aparecer — e elas dizem muito sobre o futuro do trabalho.

OIT (Organização Internacional do Trabalho, maio 2025):

1 em cada 4 empregos será transformado pela IA generativa (Nota: “transformado”, não “eliminado”)

OIT (pesquisa adicional):

PwC — Barômetro Global de Empregos em IA (2024):

Gupy — Relatório de Empregabilidade (2024):

Accenture — Future Skills Pilot:

Cada grande revolução tecnológica gerou medo de desemprego em massa:

Em todos os casos, funções específicas desapareceram — e novas, impossíveis de prever antes, surgiram. A transição foi dolorosa para quem estava nas funções certas, no momento errado. Mas o emprego total cresceu.

Independente do nível de IA, essas habilidades persistem:

| Habilidade | Por que resiste |

|---|---|

| Empatia e conexão humana | IA não tem presença, calor ou relação genuína |

| Criatividade original | Não recombinação de padrões — inovação genuinamente nova |

| Julgamento ético em contexto | Decisões que exigem valores, não apenas otimização |

| Liderança e responsabilização | Alguém precisa responder pelos resultados |

| Improvisação física | Robótica ainda muito atrás da cognição |

“A IA não substituirá humanos — mas humanos que usam IA substituirão humanos que não usam.” — Professor da Harvard Business School

Uma das perguntas mais frequentes sobre AGI não é tecnológica.

É econômica.

Se uma inteligência artificial geral realmente atingir capacidades próximas ou superiores às humanas, quais atividades profissionais seriam mais afetadas?

Embora ninguém saiba exatamente como essa transição ocorrerá, algumas tendências já podem ser observadas.

Programação é uma das áreas onde a IA mais avançou nos últimos anos.

Sistemas atuais já conseguem escrever código, corrigir erros, gerar documentação e criar aplicações completas a partir de descrições em linguagem natural.

Uma AGI ampliaria drasticamente essa capacidade.

Campanhas publicitárias, pesquisas de mercado, produção de conteúdo e personalização de mensagens podem ser fortemente automatizadas.

A diferença é que uma AGI seria capaz de compreender objetivos estratégicos com muito mais profundidade do que os sistemas atuais.

Grande parte das atividades operacionais de suporte pode ser executada por sistemas inteligentes.

Com AGI, a capacidade de lidar com situações inéditas e contextos complexos aumentaria significativamente.

Analistas financeiros, pesquisadores e consultores trabalham transformando informação em conhecimento.

Uma AGI teria potencial para acelerar esse processo em níveis sem precedentes.

Mesmo em cenários de alta automação, algumas capacidades permanecem especialmente relevantes:

A questão central não é quais profissões desaparecem.

É quais atividades dentro de cada profissão deixam de ser executadas por humanos.

Além da regulação, outro fator pode limitar o avanço da inteligência artificial: a disponibilidade de infraestrutura computacional. Esse desafio é explorado em A Crise do Hardware: o gargalo invisível que pode travar a inteligência artificial.

O AI Act da UE é a regulação mais completa do mundo para IA:

O governo dos EUA tem preferido acordos voluntários com empresas, evitando regulação hard.

O principal motivo: competição com a China. Regulação demais pode desacelerar inovação americana.

Em 2025, a pressão por legislação federal específica cresceu — mas o Congresso não chegou a consenso.

A China combina:

É uma abordagem radicalmente diferente do modelo ocidental — e mostra que não existe um único caminho para governança de IA.

O Brasil está desenvolvendo um PL de Inteligência Artificial, com debates ativos no Congresso. A proposta discute a criação de um Sistema Nacional de Regulação e Governança de IA (SIA) sob responsabilidade da ANPD.

O secretário-executivo do Ministério da Fazenda resumiu o dilema nacional:

“Regulação não inibe inovação. A verdadeira escolha é qual tipo de inovação queremos — que traz prosperidade e bem-estar, ou uma inovação desregulada que traz concentração econômica e violências.”

O Brasil tem a oportunidade de se posicionar como referência em regulação equilibrada. Mas a janela de tempo para isso é estreita.

Quem defende: Sam Altman, Dario Amodei, Elon Musk

Argumento central:

Contra-argumento:

Quem defende: Andrew Ng, Gary Marcus, Robin Li

Argumento central:

Contra-argumento:

Quem defende: Daniela Amodei, crescente número de pesquisadores práticos

Argumento central:

💡 Esta talvez seja a visão mais útil para profissionais que precisam tomar decisões hoje: pare de esperar pela AGI perfeita e comece a usar as ferramentas extraordinárias que já existem.

Independentemente da data em que a AGI surgir, empresas já estão reorganizando operações inteiras ao redor da inteligência artificial. Esse movimento é aprofundado em Mentalidade AI-first: o que é, como funciona e por que está redefinindo as empresas.

→ Aprenda a trabalhar com IA agora. Não espere a AGI. Os sistemas atuais já são extraordinariamente úteis — e quem dominar seu uso tem vantagem crescente. A demanda por profissionais com conhecimento em IA cresceu 306% em 2024.

→ Desenvolva habilidades difíceis de automatizar. Empatia, liderança, criatividade original, julgamento ético — essas são as habilidades que persistem independente do nível de IA.

→ Pense em “colaboração com IA”, não substituição. O modelo emergente não é “humano ou IA” — é “humano + IA”. Aprender a orquestrar sistemas de IA é a habilidade mais relevante dos próximos anos.

→ Acompanhe sem catastrofismo nem ingenuidade. AGI pode chegar em 5 anos ou em 30. Nenhum dos dois extremos (pânico ou indiferença) é a resposta útil.

→ Automatize o operacional agora. Cada hora que sua equipe gasta em tarefas que a IA atual já resolve é uma hora perdida de vantagem competitiva.

→ Construa processos resilientes. Quanto mais você integra IA em operações críticas, mais precisa de supervisão humana, tratamento de erros e planos de contingência.

→ Invista em alfabetização em IA para toda a equipe. O ROI de ter toda a equipe competente em IA é muito maior do que ter um especialista isolado.

→ Engaje no debate regulatório. O PL de IA do Brasil está sendo escrito agora. Decisões tomadas hoje vão moldar como a tecnologia se desenvolve no país por décadas.

→ Exija transparência. Quem treina os modelos? Com quais dados? Com quais salvaguardas? Essas perguntas têm respostas — e devem ser respondidas publicamente.

Toda semana, o SPTechBR publica análises profundas sobre IA, seus impactos no trabalho e nos negócios, e as ferramentas que realmente importam.

Sem ruído. Sem hype. Só o que muda de fato.

AGI significa Inteligência Artificial Geral (Artificial General Intelligence). É um sistema de IA capaz de realizar qualquer tarefa intelectual humana — aprendendo, raciocínando e se adaptando autonomamente em qualquer contexto, sem precisar de treinamento específico para cada situação. Em 2025, a AGI ainda não existe.

Não. Os sistemas mais avançados de 2025 — Claude, GPT-4o, Gemini — são inteligência artificial estreita (ANI): extraordinariamente capazes em domínios específicos, mas sem a generalização verdadeira que define a AGI. Em programação e análise científica, alguns sistemas já superam humanos. Mas a flexibilidade cognitiva completa da AGI ainda não foi alcançada.

Não. O ChatGPT é um modelo de linguagem de grande escala (LLM) — poderoso em linguagem, mas limitado a padrões aprendidos durante o treinamento. Ele não aprende autonomamente com novas experiências, não tem compreensão causal do mundo e falha em situações genuinamente novas. É ANI avançada, não AGI.

Não há consenso. As previsões variam amplamente:

Sam Altman (OpenAI): antes de 2029

Dario Amodei (Anthropic): 2026-2027

Demis Hassabis (DeepMind): 3 a 5 anos

Andrew Ng: muitas décadas

Daniela Amodei: o conceito está se tornando obsoleto

AGI é uma IA com capacidade cognitiva equivalente à humana em todos os domínios. Superinteligência (ASI) é o estágio além: uma IA que supera drasticamente a inteligência humana em todos os aspectos. AGI ainda é uma meta não alcançada. ASI é hipotética. A preocupação de especialistas é que a transição de AGI para ASI possa acontecer rapidamente, de forma difícil de controlar.

A OIT estima que 1 em cada 4 empregos será transformado (não eliminado) pela IA generativa. A AGI aceleraria esse processo para muito mais setores, incluindo trabalho cognitivo avançado. Mas o padrão histórico de revoluções tecnológicas sugere que novas funções surgem — mesmo que a transição seja dolorosa para quem está nas funções certas no momento errado. Habilidades de alto valor humano (empatia, criatividade genuína, liderança, julgamento ético) são mais resilientes.

Pesquisadores sérios identificam riscos reais: desalinhamento de valores, concentração de poder, aceleração descontrolada. Não são riscos de ficção científica — são problemas técnicos e políticos concretos, que laboratórios como a Anthropic e governos ao redor do mundo estão ativamente trabalhando para prevenir.

Voltemos à cena inicial.

Três CEOs. Uma semana. Três visões completamente diferentes sobre o que é AGI e quando chega.

Essa divergência não é fraqueza — é honestidade.

O que sabemos com razoável confiança:

✅ AGI completa não existe em 2025 — mas a fronteira com ANI avançada está ficando nebulosa ✅ O progresso dos últimos 5 anos superou o que praticamente todos previram ✅ O impacto, quando vier, será comparável à Revolução Industrial ✅ Os riscos são reais e merecem atenção séria — não catastrofismo, não indiferença

A pergunta que fica não é se a AGI vai mudar tudo.

Ela vai. Em maior ou menor grau, mais rápida ou mais lentamente.

A pergunta que importa é: você vai entender o que está acontecendo antes que seja óbvio para todos?

Automação com IA: como eliminar tarefas repetitivas e recuperar horas da sua semana (guia completo 2026)

Descubra como usar IA para automatizar tarefas do dia a dia e ganhar produtividade real no trabalho.

Freepik com IA: a plataforma que virou suíte criativa completa (e quase ninguém percebeu)

Entenda como o Freepik evoluiu com IA e se tornou uma ferramenta poderosa para criação de conteúdo.

A Crise do Hardware: o gargalo invisível que pode travar a inteligência artificial

Veja por que chips e infraestrutura podem limitar o avanço da IA — e o impacto disso no futuro da tecnologia.

Para aprofundar no debate sobre AGI (Inteligência Artificial Geral), consulte análises técnicas e projeções de especialistas em português sobre timelines e impactos transformadores.