Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

📩 Receba análises semanais sobre inteligência artificial, inovação e tecnologia.

Assine a newsletter do SPTechBR e acompanhe as principais tendências da nova economia digital.

Hallucination IA é um dos maiores desafios da inteligência artificial moderna.

Esse fenômeno ocorre quando modelos como ChatGPT geram informações falsas ou inventadas que parecem plausíveis, criando um problema sério de confiabilidade para empresas, pesquisadores e usuários.

A inteligência artificial generativa revolucionou a forma como produzimos informação. Ferramentas como ChatGPT, Claude, Gemini e Copilot conseguem escrever textos, responder perguntas complexas, gerar código e até produzir análises sofisticadas em segundos.

Mas existe um problema central que acompanha essa tecnologia desde o início:

modelos de IA podem inventar informações.

Esse fenômeno é conhecido como hallucination em inteligência artificial.

Em vez de simplesmente dizer “não sei”, o modelo gera uma resposta plausível — porém falsa ou parcialmente incorreta.

Esse comportamento tem implicações profundas.

Ele afeta diretamente:

Hoje, reduzir hallucinations é uma das maiores prioridades da indústria de IA.

Empresas como:

estão investindo bilhões de dólares em novas arquiteturas e métodos de verificação para tentar resolver o problema.

Mas existe uma pergunta fundamental:

Será que é possível eliminar completamente as hallucinations?

O termo hallucination em inteligência artificial descreve um comportamento específico dos modelos de linguagem.

Ele acontece quando um sistema de IA:

O usuário, muitas vezes, não percebe que a resposta contém erros.

Isso acontece porque os modelos de IA são extremamente bons em imitar linguagem humana.

Eles conseguem produzir respostas que parecem:

Mesmo quando o conteúdo é completamente inventado.

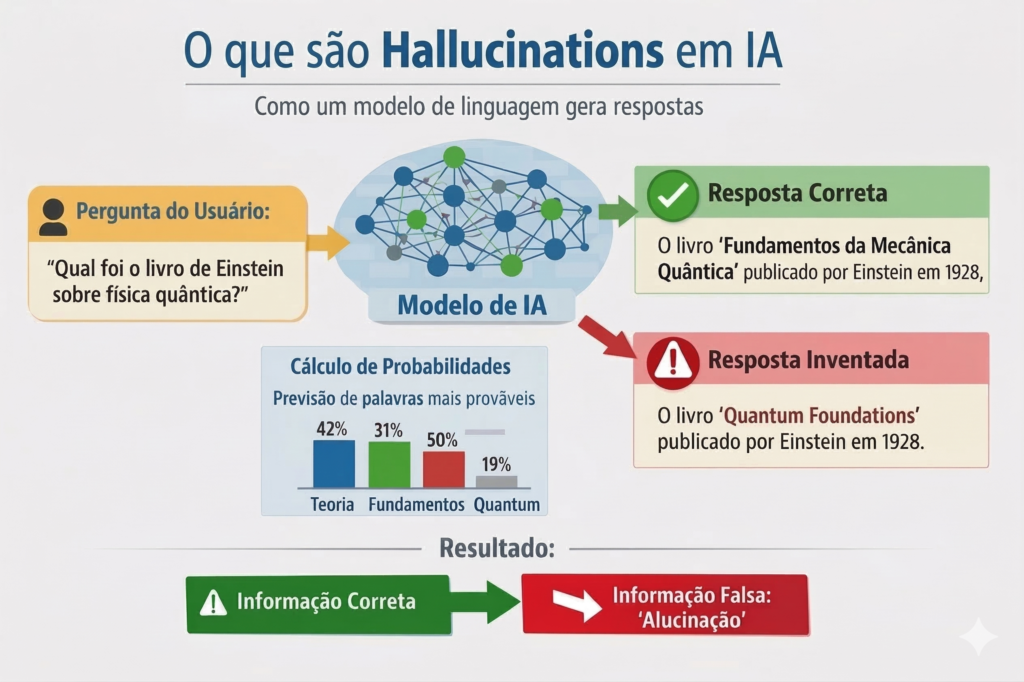

Pergunta ao modelo:

“Qual foi o livro publicado por Albert Einstein em 1928 sobre mecânica quântica?”

Resposta de IA (exemplo fictício):

“O livro Quantum Foundations publicado por Einstein em 1928 discute…”

O problema?

Esse livro nunca existiu.

Mas o modelo consegue criar uma resposta extremamente plausível.

Para entender o problema das hallucinations, precisamos compreender como funcionam os grandes modelos de linguagem (LLMs).

Esses sistemas são treinados com trilhões de palavras extraídas da internet, livros, artigos e documentos.

O objetivo do treinamento é simples:

prever a próxima palavra em uma frase.

Exemplo simplificado:

“A capital da França é…”

O modelo calcula qual palavra tem maior probabilidade de aparecer em seguida.

Resultado:

“Paris”

Mas esse processo é estatístico, não factual.

O modelo não “sabe” que Paris é a capital.

Ele apenas sabe que essa sequência aparece frequentemente nos dados de treinamento.

Os modelos de linguagem funcionam com probabilidade condicional.

Eles analisam padrões estatísticos entre palavras.

Isso significa que o sistema aprende relações como:

Mas isso não equivale a conhecimento real.

Em termos técnicos, o modelo aprende representações matemáticas da linguagem, chamadas embeddings.

Essas representações capturam padrões semânticos, mas não verificam fatos.

Outro fator importante é que os modelos não possuem, por padrão:

Se uma pergunta exige um dado específico que não está claro nos padrões aprendidos, o modelo pode:

E faz isso com extrema confiança.

Nem todas as hallucinations são iguais.

Algumas aparecem como pequenos erros factuais.

Outras podem gerar consequências graves.

Os principais tipos incluem:

Quando o modelo inventa um fato.

Exemplo:

O modelo cita:

Esse problema é comum em perguntas acadêmicas.

A IA atribui frases a pessoas famosas.

Exemplo:

“Steve Jobs disse que a inteligência artificial substituiria todos os programadores.”

Provavelmente nunca foi dito.

O modelo mistura:

Isso cria respostas parcialmente verdadeiras, o que torna o erro mais difícil de detectar.

LLMs também podem cometer erros em:

Embora modelos mais recentes tenham melhorado bastante nesse aspecto.

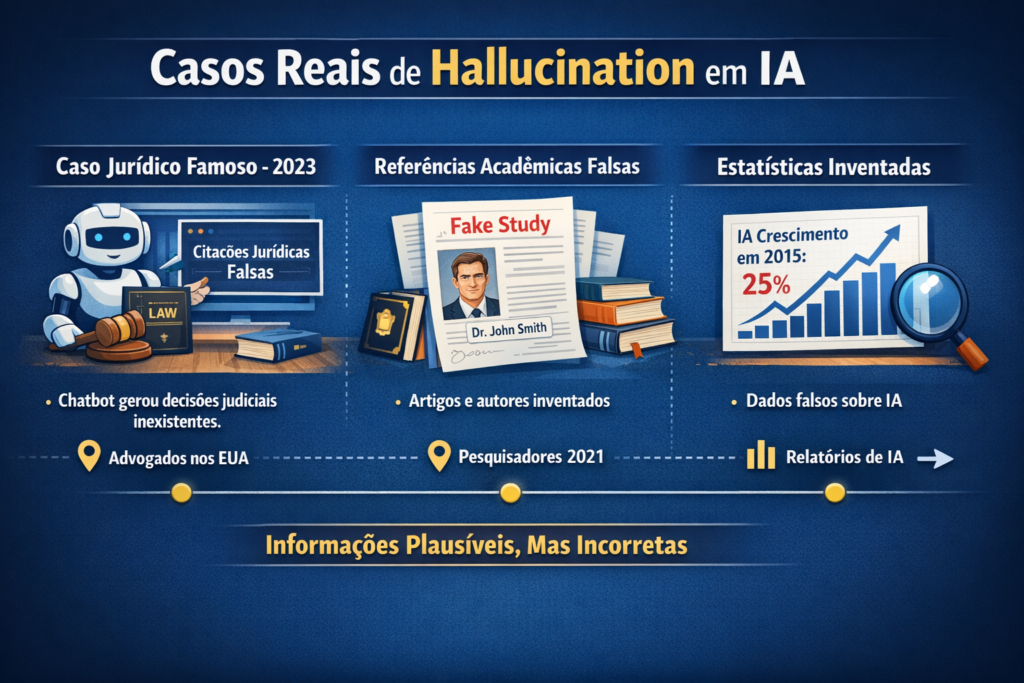

Nos últimos anos, vários casos reais chamaram atenção para o problema.

Advogados nos Estados Unidos usaram um chatbot para ajudar na preparação de um processo judicial.

O sistema gerou citações de decisões judiciais que não existiam.

Quando o tribunal verificou as referências, descobriu que os casos eram completamente inventados.

Resultado:

os advogados foram advertidos pelo tribunal.

Pesquisadores também observaram que modelos de IA frequentemente criam:

Isso é particularmente problemático em ambientes acadêmicos.

Outro exemplo comum:

usuários pedem dados como:

“Qual a taxa de crescimento da IA em 2015?”

Se o modelo não tiver informação clara, ele pode gerar um número plausível.

Mas completamente inventado.

Resolver completamente esse problema é extremamente complexo.

Isso acontece por várias razões estruturais.

LLMs são essencialmente modelos probabilísticos.

Eles não possuem um mecanismo interno robusto para diferenciar:

Os modelos são treinados com dados da internet.

Esses dados incluem:

A linguagem humana é ambígua.

Uma mesma pergunta pode ter:

Isso aumenta o risco de respostas incorretas.

Modelos generativos são projetados para:

Isso aumenta criatividade, mas também a chance de erro.

A indústria de IA está desenvolvendo várias técnicas para reduzir hallucinations.

O modelo consulta bases de dados externas antes de responder.

Isso permite usar informação atualizada e verificável.

Grounding significa ancorar respostas em fontes confiáveis.

Por exemplo:

Alguns sistemas incluem etapas adicionais para:

A nova geração de sistemas combina:

A confiança será um fator decisivo para o futuro da inteligência artificial.

Empresas só podem usar IA em larga escala se os sistemas forem:

Por isso, reduzir hallucinations é essencial para aplicações em:

Muitos especialistas acreditam que hallucinations nunca desaparecerão completamente.

Em vez disso, o futuro da IA provavelmente envolverá sistemas híbridos que combinem:

É quando um modelo de inteligência artificial gera informações falsas ou inventadas.

Sim. Modelos de linguagem podem produzir respostas incorretas porque funcionam com probabilidades estatísticas.

Sim, especialmente em perguntas complexas ou muito específicas.

Provavelmente não completamente, mas novas técnicas estão reduzindo bastante o problema.

Sempre verifique informações importantes em fontes confiáveis.

🎧 Spotify — análises semanais sobre IA e tecnologia AQUI

📺 YouTube — explicações visuais sobre inovação AQUI

📩 Newsletter — receba novos artigos diretamente no seu e-mail

A programação está mudando rapidamente. O conceito de vibe coding descreve uma nova forma de desenvolvimento em que programadores usam IA para gerar código, testar ideias e acelerar a criação de software.

Rodar modelos localmente está se tornando cada vez mais popular. Isso permite mais privacidade, controle e independência de plataformas na nuvem.

De geração de texto a automação de tarefas complexas, novas ferramentas de IA já estão economizando horas de trabalho em empresas e projetos individuais.