Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

📩 Receba análises profundas sobre IA, tecnologia e o futuro do trabalho — toda semana, direto no seu e-mail.

A OpenAI publicou um documento estratégico defendendo que governos precisam agir ativamente na era da superinteligência — com investimento em infraestrutura, políticas de requalificação profissional, fundos públicos de riqueza e democratização do acesso à IA. O argumento central: a revolução da IA não é apenas tecnológica, mas econômica e institucional — e quem definir as regras agora vai definir quem ganha.

Em abril de 2026, a OpenAI lançou um material estratégico com um título que diz tudo: “Industrial Policy for the Intelligence Age: Ideas to Keep People First”.

Pela primeira vez de forma estruturada, a empresa liderada por Sam Altman propõe não apenas como construir IA — mas como reorganizar a economia, o trabalho e as instituições ao redor dela.

Li o documento com atenção. E o que mais me chamou atenção não foi o que ele diz — foi o que ele revela ao escolher dizer.

Na prática, isso significa o seguinte: quando uma das empresas mais poderosas do mundo em IA publica um relatório sobre distribuição de riqueza e fundo público de prosperidade, isso não é filantropia corporativa. É posicionamento estratégico em uma disputa que ainda está sendo definida — sobre quem controla a narrativa do que a IA significa para a sociedade.

Isso muda o mercado de uma forma específica: quem conseguir moldar essa narrativa agora vai ter vantagem desproporcional quando a regulação vier. E ela vai vir.

Esse movimento está diretamente conectado a uma transformação mais ampla que já analisamos — a transição para uma mentalidade AI-first que está redefinindo como empresas e profissionais operam →. O documento da OpenAI é, em muitos sentidos, a versão política e econômica dessa mesma transformação.

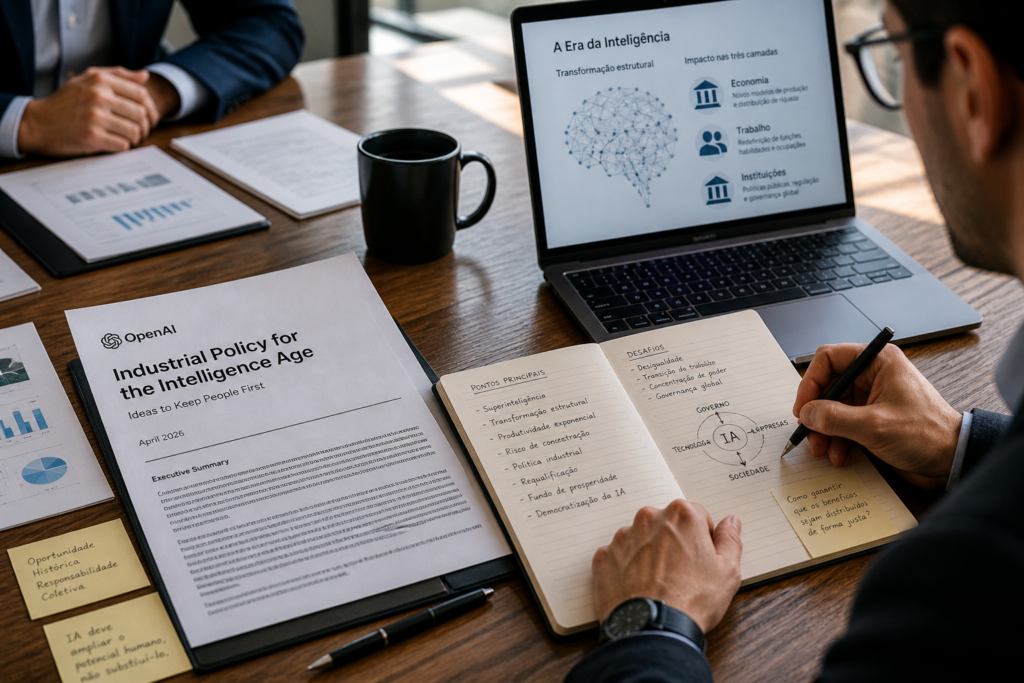

A tese principal do documento é simples. Mas as implicações são enormes — e raramente são tratadas com a seriedade que merecem.

A OpenAI usa uma comparação específica para ilustrar o que está em jogo: estamos passando de sistemas que automatizam tarefas pontuais para sistemas capazes de executar projetos inteiros que hoje levam meses de trabalho humano.

Traduzindo isso para o mercado: não estamos falando de um software que faz uma coisa mais rápido. Estamos falando de sistemas que podem compor pesquisas científicas, coordenar operações de negócio complexas e gerar conhecimento novo de forma autônoma — em velocidade que não tem precedente histórico direto.

A comparação mais honesta é com a Revolução Industrial do século XVIII. Antes dela, a produtividade humana crescia lentamente. A máquina a vapor mudou o que era possível produzir — mas também destruiu modelos de trabalho inteiros, concentrou poder em novas mãos e forçou transformações institucionais que levaram décadas para se estabilizar.

A diferença agora é a velocidade. A Revolução Industrial se desenrolou ao longo de gerações. A revolução da IA está acontecendo em anos. Para profissionais, isso representa uma pressão de adaptação que o mercado de trabalho tradicional simplesmente não foi desenhado para absorver nesse ritmo.

Esse tipo de aceleração está diretamente ligado ao surgimento de agentes de IA capazes de executar objetivos completos de forma autônoma → — não apenas tarefas isoladas, mas projetos inteiros. O documento da OpenAI é, em parte, uma tentativa de preparar o mundo institucional para o que esses sistemas vão significar quando estiverem amplamente disponíveis. E o prazo é mais curto do que a maioria dos governos está agindo como se fosse.

O documento assume uma posição relativamente direta sobre o que está vindo. Não tenta minimizar. Não usa eufemismos. E essa honestidade é notável para um documento corporativo.

O que a OpenAI espera como benefícios:

O que a OpenAI reconhece como riscos reais:

O reconhecimento desses riscos, vindo da empresa que está construindo essa tecnologia, merece atenção. Não porque seja surpreendente — qualquer análise séria chega às mesmas conclusões. Mas porque revela que a OpenAI sabe exatamente o que está colocando no mundo e prefere liderar a narrativa a ser surpreendida por ela.

Não é necessariamente cinismo. Pode ser, genuinamente, responsabilidade. Mas é importante distinguir as duas coisas ao ler o documento — especialmente quando essa mesma empresa está pedindo a governos que adotem o arcabouço regulatório que ela mesma propõe.

O documento estrutura a discussão em três pilares. Vale analisar cada um com olho crítico — não apenas o que propõe, mas o que está implícito em cada escolha.

A ideia central é evitar que a IA beneficie apenas uma elite econômica e tecnológica.

Entre as propostas: melhorar qualidade de vida via redução de custos em serviços essenciais, ampliar acesso a oportunidades econômicas para quem hoje está excluído, e prevenir concentração extrema de riqueza.

Há uma preocupação explícita com desigualdade — algo que raramente aparece com esse peso em documentos de empresas de tecnologia.

Na prática, isso significa uma coisa simples e difícil ao mesmo tempo: redistribuição de poder econômico. E redistribuição de poder econômico exige muito mais do que boa intenção — exige mecanismos concretos, consenso político e capacidade de implementação que raramente coexistem ao mesmo tempo.

A pergunta legítima é: quão concreta é essa preocupação quando vem de uma empresa que está simultaneamente construindo a tecnologia que pode acelerar essa concentração? A resposta honesta é: incerta. Intenção não é política. E política não é implementação.

Aqui entram as discussões sobre criação de novas instituições de segurança, desenvolvimento de salvaguardas técnicas e proteção de sistemas críticos.

O princípio central é claro: segurança precisa evoluir junto com capacidade. Um sistema mais poderoso sem mecanismos de controle proporcionalmente mais robustos é uma aposta perigosa — e uma aposta que toda a sociedade faz, não apenas a empresa que desenvolve o sistema.

O problema prático é que a velocidade de desenvolvimento de capacidade está superando consistentemente a velocidade de desenvolvimento de salvaguardas. Isso não é uma crítica específica à OpenAI — é uma característica estrutural do campo. Mas é uma lacuna real que o documento reconhece sem resolver. Mencionar o problema não é o mesmo que ter a solução.

Talvez o ponto mais interessante — e o mais estratégico do ponto de vista da OpenAI como empresa.

A proposta é próxima de um “direito à IA”: acesso amplo a modelos úteis, preços acessíveis, preservação de privacidade e aumento da autonomia individual.

O que torna isso estratégico é que a OpenAI está simultaneamente defendendo democratização e sendo um dos maiores gatekeepers do acesso à IA avançada. Não é hipocrisia necessariamente — pode ser o reconhecimento genuíno de que democratizar acesso é a melhor forma de evitar backlash regulatório que poderia limitar sua própria operação.

De qualquer forma, essa democratização já está acontecendo na prática. Como documentamos ao analisar como apps estão sendo criados com IA em dias por fundadores sem formação técnica →, a barreira de entrada para criar software caiu radicalmente. O documento propõe uma versão institucionalizada do que o mercado já está fazendo de forma orgânica — com ou sem política pública de suporte.

Aqui o documento fica realmente interessante. E mais controverso.

A OpenAI defende que governos precisam agir. Não apenas observar, regulamentar marginalmente ou criar comitês de estudo. Agir, com política industrial real.

Isso inclui investimento público em infraestrutura — energia, data centers, conectividade — políticas ativas de formação e requalificação de mão de obra, incentivos à inovação que não se concentrem apenas em grandes players, e regulação equilibrada que proteja sem bloquear.

Para colocar em perspectiva: quando a internet surgiu, os países que investiram em infraestrutura digital cedo — Coreia do Sul, Suécia, partes dos EUA — construíram vantagens que duraram décadas. A OpenAI está essencialmente argumentando que a IA é o equivalente contemporâneo dessa infraestrutura. E que quem não agir agora vai pagar o preço depois.

Essa lógica não está errada. A questão é quem vai implementar, com que critérios e beneficiando quem.

O cuidado explícito é relevante: o documento adverte contra regulação que sirva para proteger grandes empresas estabelecidas e bloquear concorrência. É uma ressalva que protege a OpenAI de ser acusada de defender regulação autoprotetora — mas que também reflete um problema real: regulações complexas frequentemente favorecem quem tem recursos para lidar com elas.

Na prática, implementar essa visão exige o tipo de automação com IA integrada a fluxos reais de operação → que vai muito além de políticas declaratórias. A política pública define o arcabouço — mas é a adoção prática que determina o impacto.

A proposta de um fundo público que distribuiria os ganhos da IA diretamente para a população é a mais radical do documento.

A lógica é defensável: se a IA gera ganhos de produtividade enormes, mas esses ganhos se concentram em quem possui os modelos e a infraestrutura, o resultado é riqueza sem distribuição. Um fundo público — similar ao Fundo Permanente do Alaska, que distribui dividendos de petróleo para residentes — seria um mecanismo concreto de compartilhamento.

Na prática, criar e operacionalizar esse fundo exigiria consenso político que raramente existe em torno de questões econômicas tão significativas. É uma ideia que merece debate sério — não como solução definitiva, mas como provocação para pensar em mecanismos alternativos.

Desligar benefícios como saúde e aposentadoria do emprego tradicional é uma ideia que ganhou urgência com a ascensão do trabalho por projeto e freelancing.

Para um trabalhador comum, traduzindo de forma direta: se você perde o emprego ou muda de função, você não perde o plano de saúde nem a previdência. Eles ficam com você — não com o empregador.

Isso é especialmente relevante em um cenário onde a IA vai acelerar a transição de pessoas entre funções. Quem usa ferramentas de IA no trabalho para aumentar produtividade → já experimenta hoje uma versão dessa transição acelerada — mas sem a rede de proteção que o documento propõe.

Esse é, talvez, o ponto onde o mercado já está na frente da política pública.

Fundadores solo, consultores independentes e pequenas equipes já estão usando IA para operar como empresas maiores — sem esperar por nenhuma política de suporte. A diferença seria um arcabouço institucional que tornasse esse caminho acessível para além de quem já tem recursos e informação.

Como mostramos ao documentar como profissionais estão operando como empresas inteiras usando IA como infraestrutura →, o modelo de “empresa de uma pessoa só” já é realidade para quem sabe usar as ferramentas certas. A proposta do documento seria democratizar isso — não apenas para quem já tem acesso.

A proposta de testar semanas de trabalho reduzidas é intuitivamente atraente. Se a IA faz em duas horas o que levava oito, por que a jornada precisa ser a mesma?

O problema é que os ganhos de produtividade da IA frequentemente se traduzem em mais output — não em menos horas. A distribuição desses ganhos entre trabalhadores e empresas depende de poder de negociação, não de lógica de eficiência.

É uma hipótese que merece teste empírico sério. Mas apresentá-la como consequência natural da IA seria otimismo prematuro.

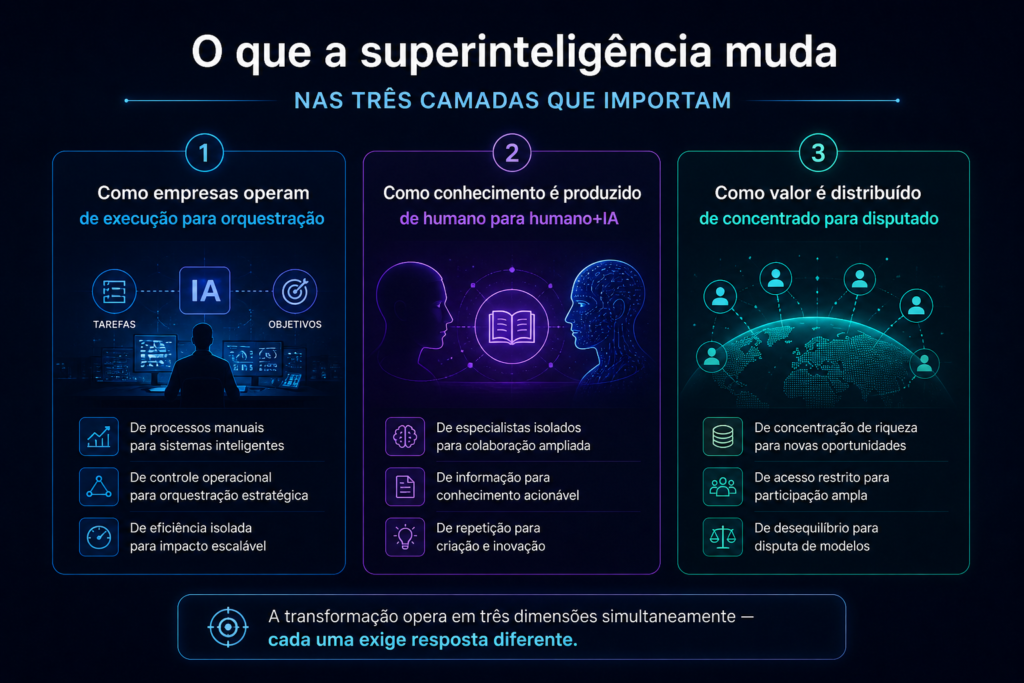

O documento reconhece algo que qualquer análise honesta chega: o impacto da IA no trabalho não vai ser linear, uniforme ou justo por padrão.

Algumas funções vão desaparecer — especialmente as que envolvem processamento de informação repetitiva e previsível. Outras serão transformadas — com o profissional assumindo papel de direção e julgamento enquanto a IA faz a execução. Novas funções vão surgir em áreas que ainda mal conseguimos nomear.

O que o documento faz bem é reconhecer que nem todos os trabalhadores vão se beneficiar automaticamente. A ideia de que “a IA vai criar mais empregos do que destruir” pressupõe que as pessoas que perdem empregos em um setor conseguem rapidamente as habilidades necessárias para os empregos que surgem em outro. Essa transição raramente é fluida — e historicamente, o gap entre a destruição e a criação é onde a desigualdade se aprofunda.

Por isso a ênfase em requalificação, proteção social adaptativa e transição estruturada.

O que o documento não diz com clareza suficiente: a velocidade da automação vai provavelmente superar a velocidade das políticas de adaptação. Esse gap — entre o ritmo do mercado e o ritmo das instituições — é onde o problema vai aparecer primeiro.

Como mostramos ao analisar como a IA no trabalho está redistribuindo tarefas e o que isso muda para profissionais →, a transição já está acontecendo. Com ou sem política pública de suporte. E a pergunta prática para qualquer profissional não é “quando isso vai me afetar” — é “o que estou fazendo agora enquanto ainda há tempo de escolher?”

"A janela para influenciar como essa transição acontece está aberta agora — não por muito mais tempo."Crédito: Análise SPTechBR — documento OpenAI, 2026

Um dos pontos mais relevantes é o reconhecimento explícito de um risco que a própria OpenAI cria ao existir.

A empresa admite que empresas como ela podem concentrar poder de forma desproporcional. Que os ganhos da IA podem não ser distribuídos. Que o acesso pode ser desigual.

Isso é raro em um documento corporativo — e merece leitura cuidadosa.

Existe uma tensão que o documento não resolve: a OpenAI está simultaneamente alertando para os riscos de concentração de poder na IA e sendo uma das maiores fontes potenciais dessa concentração. Não é impossível que as duas coisas coexistam de forma legítima. Mas exige ceticismo saudável.

Quando uma empresa que detém capacidade tecnológica sem precedente propõe o arcabouço regulatório para o seu próprio setor, vale perguntar: quem mais está na mesa dessa conversa?

A resposta honesta é: ainda poucos. Governos estão correndo para entender o que precisam regular. A sociedade civil está se organizando. Trabalhadores afetados raramente têm voz em fóruns onde essas decisões são tomadas.

O documento da OpenAI é uma contribuição para esse debate. Mas não deve ser confundido com o debate em si.

Não é mais “se” a IA vai transformar economia e trabalho. É “como lidar com uma transformação que já está em andamento.”

Na prática, isso significa que qualquer estratégia pessoal ou empresarial que ainda trata a IA como “tendência para acompanhar” já está atrasada. O debate tecnológico ficou para trás — o debate agora é econômico, político e institucional.

É institucional, econômico e social. Os modelos de linguagem estão avançando. O que está atrasando é a capacidade das instituições — governos, sindicatos, sistemas educacionais — de adaptar em velocidade compatível.

Isso explica por que profissionais que entendem como usar IA de forma estratégica têm vantagem tão desproporcional hoje. Não porque a tecnologia é difícil — mas porque a maioria das organizações ainda não criou os incentivos para adoção generalizada.

Como mostramos ao documentar como criar produtos com IA em 2026 →, o gap entre o que é possível e o que está sendo usado é enorme. E é exatamente nesse gap que estão as maiores oportunidades — para quem se posiciona agora.

Quem define as regras define o resultado. E nessa disputa, as empresas de IA têm uma vantagem estrutural significativa: elas entendem melhor do que qualquer regulador o que a tecnologia pode fazer.

Isso não significa que o interesse público está automaticamente em conflito com o interesse dessas empresas. Significa que a assimetria de informação é real — e que o debate precisa de mais vozes além das empresas de tecnologia e dos governos que as tentam regular.

Vou ser direto sobre o que esse documento significa para quem está navegando essa transição agora.

Se você é trabalhador em uma função com alta componente repetitiva: o documento confirma o que os dados já mostravam. A transição vai acontecer. O ritmo vai depender do setor. O que está sob seu controle é desenvolver habilidades que a IA complementa — não que ela substitui.

Ferramentas como workflows com IA que automatizam o operacional → já existem e já estão sendo usadas por concorrentes. A questão não é se adotar — é quando, e com que nível de preparação.

Se você é empreendedor ou profissional independente: o cenário descrito no documento é, em muitos aspectos, favorável. A IA como infraestrutura de operação amplia o que uma pessoa ou uma pequena equipe consegue fazer. Estamos caminhando para um modelo onde as ferramentas fazem grande parte da execução operacional, deixando os profissionais para o que exige julgamento real.

Se você é gestor ou líder empresarial: a questão não é mais se adotar IA, mas como construir uma operação que use IA de forma estratégica. Quem ainda está na fase de “testar ferramentas” vai ter dificuldade competindo com quem já tem processos automatizados integrados à operação.

Esse documento não é apenas um posicionamento corporativo. É um sinal de mudança de fase — e merece ser lido como tal.

A discussão sobre IA entrou oficialmente em um novo território: menos sobre ferramentas e mais sobre sistemas. Menos sobre produtividade individual e mais sobre poder e distribuição. Menos sobre o que a tecnologia pode fazer e mais sobre quem vai ter acesso, quem vai definir as regras e quem vai pagar o preço quando as coisas não saírem como planejado.

E talvez o ponto mais importante, que o documento deixa implícito sem nunca dizer diretamente: a janela para influenciar como essa transição acontece está aberta agora — não por muito mais tempo.

Quando a infraestrutura estiver construída, quando os modelos estiverem ainda mais integrados às operações de negócio, quando as dependências estiverem estabelecidas — as opções de como organizar tudo isso vão ser muito mais limitadas. É assim que transformações estruturais funcionam: as decisões que importam são tomadas cedo, quando parecem prematuras, não tarde, quando parecem óbvias.

Para profissionais e empresas, isso se traduz em algo concreto: o custo de esperar é maior do que o custo de se adaptar agora. E os que estiverem construindo capacidade de operar com IA agora — seja via apps criados com IA → ou via automação de processos internos — vão chegar ao próximo ciclo com vantagem estrutural que será difícil de compensar depois.

A forma como governos, empresas e profissionais responderem nos próximos 12 a 24 meses vai determinar quem captura os benefícios dessa transformação e quem absorve os custos.

Esse é o jogo. E ele já começou.

📩 A IA não está apenas mudando ferramentas — está redefinindo economia, trabalho e poder. Toda semana, o SPTechBR analisa o que realmente importa nesse cenário, sem hype e com profundidade real.

🔗 Como rodar IA local em 2026: guia prático com Ollama, LM Studio e os melhores modelos open source

Descubra como executar modelos de IA no seu próprio computador, com mais privacidade, controle e sem depender da nuvem — um movimento que está ganhando força entre profissionais e empresas.

🔗 O fim do gerenciamento de projetos? Como a IA está transformando Jira, Notion, ClickUp — e o trabalho em si

Entenda como ferramentas tradicionais estão evoluindo com inteligência artificial e por que a gestão de projetos está deixando de ser apenas organização para se tornar execução automatizada.

🔗 Notion AI na prática: como organizar seu trabalho e ganhar produtividade real com IA

Veja como usar o Notion com IA para estruturar projetos, automatizar tarefas e transformar caos em sistemas produtivos no dia a dia.

É um relatório estratégico publicado em abril de 2026 chamado “Industrial Policy for the Intelligence Age”. Ele propõe como governos e sociedade devem se preparar para a era da superinteligência — com foco em distribuição de prosperidade, mitigação de riscos e democratização do acesso à IA.

Sim — mas uma regulação específica: equilibrada entre segurança e inovação, que não sirva para proteger grandes empresas estabelecidas nem bloqueie concorrência. O documento defende ação ativa de governos, não apenas supervisão passiva.

A ideia de que o acesso à inteligência artificial deve ser amplo, acessível e não concentrado em poucas empresas ou países — com preços acessíveis, preservação de privacidade e aumento da autonomia individual como princípios de acesso.

O documento reconhece que vai transformar e substituir funções — sem minimizar o impacto. Propõe mecanismos de transição: requalificação, proteção social adaptativa e novas formas de empreendedorismo. A visão não é otimismo ingênuo nem catastrofismo — é reconhecimento de que a transição vai ser real e vai exigir resposta estruturada.

Um fundo público que distribuiria parte dos ganhos gerados pela IA diretamente para a população — similar ao Fundo Permanente do Alaska. É a proposta mais radical do documento e a mais difícil de implementar politicamente.

Merece leitura crítica. A OpenAI tem interesses claros na narrativa sobre como a IA deve ser governada. Ao mesmo tempo, muitas análises são consistentes com o que pesquisadores independentes chegam por outros caminhos. A recomendação é ler com atenção para o que o documento propõe — e também para o que omite ou deixa vago.

Que a janela para desenvolver habilidades que complementam a IA — em vez de competir com ela — ainda está aberta. Profissionais que entendem como usar IA de forma estratégica têm vantagem desproporcional no mercado atual, exatamente porque a maioria das instituições ainda não criou os incentivos para adoção generalizada.

O que está acontecendo: democratização tecnológica de fato, com ferramentas de IA acessíveis a profissionais e pequenos empreendedores. O que o documento propõe: um arcabouço institucional que garanta que essa democratização seja estrutural — não apenas para quem já tem acesso a recursos e informação.

OpenAI documento “Política Industrial para Era da Inteligência” (abril 2026): fundo riqueza pública, semana 4 dias, requalificação; distribui ganhos IA.

OpenAI documento “Política Industrial para Era da Inteligência” (abril 2026): fundo riqueza pública, semana 4 dias, requalificação; distribui ganhos IA.

A inteligência artificial está evoluindo rápido — mas entender o que realmente muda no trabalho, nos negócios e na economia é o que faz diferença.

No SPTechBR, você recebe análises profundas, guias práticos e tendências explicadas sem hype — direto no seu e-mail.

👉 Assine a newsletter e fique à frente nas transformações da tecnologia.