Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

A inteligência artificial avança como nunca.

Toda semana, um novo modelo. Uma nova capacidade. Uma nova fronteira cruzada.

Mas há um problema crescendo em silêncio por baixo de todo esse avanço — e ele não está no código.

Está no silício. Na energia. Na geopolítica. Nas fábricas que o mundo não tem rápido o suficiente para construir.

O hardware não está conseguindo acompanhar a IA que criou.

E essa defasagem pode se tornar o maior limitador tecnológico da próxima década — não por falta de ideias, mas por falta de chips, energia e infraestrutura para realizá-las.

Este artigo explora a fundo essa crise: de onde veio, quem está no centro dela, o que os dados dizem e para onde isso está nos levando.

💡 O que é a crise do hardware? É a convergência de limitações físicas, econômicas, geopolíticas e energéticas que tornam cada vez mais difícil — e mais caro — expandir a infraestrutura computacional que a IA moderna exige.

🎥 Assista este conteúdo no YouTube e aprofunde a análise visualmente

🎧 Ouça o episódio completo no Spotify e entenda os bastidores da crise do hardware

Antes de qualquer explicação, os fatos concretos de hoje:

Esses números têm nome, têm data e têm consequências.

Mas para entender como chegamos aqui, é preciso voltar 60 anos.

O número de transistores em um chip dobra a cada dois anos. E o custo cai na mesma proporção.

Essa observação — batizada de Lei de Moore — se tornaria a profecia mais autorrealizável da história da tecnologia.

Por décadas, ela funcionou como um subsídio oculto para toda a indústria.

Pense assim: software ficava mais pesado, mais complexo, mais exigente. Mas o hardware ficava mais rápido e mais barato ao mesmo tempo — absorvendo a ineficiência, sem que ninguém precisasse se preocupar muito.

Empresas podiam escrever código mal otimizado. Podiam adicionar funcionalidades sem se perguntar sobre custo computacional. O próximo ciclo de chips resolveria.

Era como ter um faxineiro invisível que sempre limpava a bagunça.

Intel, AMD e NVIDIA construíram impérios em cima dessa dinâmica. O setor de semicondutores foi responsável por um dos maiores ciclos de criação de riqueza da história econômica moderna.

A partir de 2010, a magia começou a quebrar. Os motivos são físicos, econômicos e humanos:

🔬 O limite do átomo

Transistores modernos têm 2 a 3 nanômetros — tamanho comparável a alguns átomos.

Para ter noção: um fio de cabelo humano tem aproximadamente 80.000 nanômetros de espessura. Um transistor moderno é 40.000 vezes menor.

Nessa escala, a física quântica começa a sabotear o processo: elétrons “vazam” por paredes que deveriam ser isolantes, chips aquecem, circuitos ficam instáveis. Não existe como continuar miniaturizando indefinidamente — a natureza impõe um piso.

💰 O custo que explodiu

Construir uma fábrica de chips de ponta — chamada de fab — custa entre US$ 15 e US$ 20 bilhões.

A TSMC, principal fabricante do mundo, anunciou mais de US$ 100 bilhões em investimentos para construir novas instalações nos EUA e no Japão. Sozinha. Em um único ciclo de expansão.

Isso não é fabricação. É infraestrutura de Estado.

👷 A escassez de pessoas

Quando a TSMC tentou abrir sua fábrica no Arizona, o projeto atrasou mais de um ano.

O motivo? A empresa não encontrou engenheiros com qualificação suficiente nos EUA para operar equipamentos de fabricação de chips de última geração.

Máquinas caríssimas ficaram paradas esperando pessoas.

⚠️ O resultado prático: Os chips continuam melhorando. Mas os ganhos são menores, mais lentos e exponencialmente mais caros a cada geração.

O faxineiro invisível está pedindo demissão.

Durante décadas, a demanda por hardware cresceu de forma previsível.

Novos smartphones. Laptops mais potentes. Servidores corporativos. O ritmo era administrável.

Aí chegou o ChatGPT.

Em novembro de 2022, a OpenAI lançou aquilo que se tornaria o produto de crescimento mais rápido da história:

Para efeito de comparação: o Instagram levou 2,5 anos para chegar a 100 milhões. O TikTok levou 9 meses.

O ChatGPT levou 60 dias.

O efeito dominó foi imediato. Google, Meta, Amazon, Microsoft, xAI, Anthropic, Mistral, DeepSeek — dezenas de empresas passaram a competir para treinar modelos cada vez maiores, cada vez mais rápido. E treinar um modelo grande é extraordinariamente caro em termos de hardware.

Para tornar concreto o que significa “treinar um modelo”:

Imagine ligar 10.000 computadores de alto desempenho ao mesmo tempo, por 3 meses seguidos, sem desligar nenhum. Isso se aproxima do que é necessário para treinar um modelo de linguagem de fronteira hoje.

O problema: há pouquíssimas dessas GPUs no mundo. E elas estão todas reservadas.

As GPUs foram criadas para renderizar gráficos em videogames.

Sua arquitetura, baseada em milhares de núcleos pequenos trabalhando em paralelo, mostrou-se acidentalmente perfeita para o tipo de matemática que redes neurais exigem — multiplicações de matrizes em escala massiva.

A NVIDIA percebeu isso antes de todos.

Em 2007, a empresa lançou a plataforma CUDA — um sistema que permitia usar GPUs para qualquer tipo de computação científica ou paralela, não apenas gráficos. Foi uma das apostas estratégicas mais visionárias da história corporativa recente.

Ninguém prestou muita atenção por anos.

Aí a IA explodiu — e a NVIDIA já tinha 15 anos de vantagem.

Resultado: a empresa que vendia chips para gamers se tornou, em vários momentos de 2024 e 2025, a empresa de maior valor de mercado do mundo, com capitalização próxima de US$ 3 trilhões.

Seu chip H100, lançado em 2022, virou o componente mais cobiçado da indústria. Em momentos de pico, unidades foram vendidas no mercado secundário por até US$ 40.000 cada — o dobro do preço oficial.

A NVIDIA reportou US$ 35,6 bilhões em receita de data centers em um único trimestre. Para ter referência: essa era a receita anual total de muitas grandes empresas de tecnologia há cinco anos.

A NVIDIA não tem vantagem apenas em hardware.

Tem algo mais difícil de copiar: o ecossistema CUDA.

São bilhões de linhas de código escritas por clientes ao longo de quase duas décadas, todas otimizadas para rodar em hardware NVIDIA. Migrar para chips concorrentes exige reescrever esse código — um processo custoso, arriscado e demorado.

AMD tem chips competitivos (a linha Instinct MI300X ganhou tração em 2024), mas enfrenta esse muro do ecossistema.

Intel aposta na linha Gaudi 3 para IA, mas enfrenta dificuldades técnicas e financeiras sérias — em 2024, demitiu dezenas de milhares de funcionários e adiou expansões de fábricas.

As próprias big techs estão desenvolvendo chips proprietários para reduzir dependência:

Mas nenhum desses chips está disponível no mercado aberto. São soluções proprietárias que reforçam a concentração — não resolvem a escassez.

Se a GPU é o motor de um carro de Fórmula 1, a memória HBM é o sistema de combustível.

Não importa o quão poderoso seja o motor — se o combustível não chega rápido o suficiente, o carro não acelera.

HBM (High-Bandwidth Memory) é um tipo de memória ultrarrápida produzida empilhando camadas de chips DRAM verticalmente, conectados por orifícios microscópicos chamados TSVs (Through-Silicon Vias). É um processo extraordinariamente complexo, com baixo rendimento e custo altíssimo.

O mercado é controlado por três empresas:

E o caso extremo: a SK Hynix vendeu toda sua produção de HBM de 2026 antes mesmo do ano começar.

Não é figura de linguagem. É literalmente isso.

Em outubro de 2025, a OpenAI formalizou parceria com Samsung e SK Hynix para garantir fornecimento para o Projeto Stargate — a iniciativa de US$ 500 bilhões em infraestrutura de IA anunciada com a SoftBank. Estimativas indicam que o Stargate sozinho pode consumir até 40% da produção global de DRAM — exigindo cerca de 900.000 wafers por mês.

Há um problema que raramente aparece nas manchetes — mas que travou entregas em 2024 e 2025.

O packaging avançado.

Para criar um acelerador de IA funcional, não basta ter uma GPU e uma memória HBM. Elas precisam ser integradas em um único módulo usando uma tecnologia chamada CoWoS (Chip-on-Wafer-on-Substrate) — desenvolvida pela TSMC.

A capacidade de CoWoS da TSMC estava completamente reservada até o final de 2025. Resultado: havia chips disponíveis e memória em estoque — mas os módulos não podiam ser montados por falta de capacidade de empacotamento.

É como ter todas as peças de um carro, mas sem fábrica de montagem.

A crise desceu ainda mais na cadeia produtiva.

O tecido de fibra de vidro — material usado nos substratos que conectam chips em pacotes avançados — entrou em escassez. A empresa japonesa Nitto Boseki detém virtual monopólio nesse material e não consegue expandir produção no ritmo que a demanda exige.

Resultado: Qualcomm, Apple, NVIDIA e AMD competem pelo mesmo insumo básico. Um material que custa centavos pode atrasar chips que custam dezenas de milhares de dólares.

Um único fato resume a fragilidade estrutural da cadeia de suprimentos de semicondutores:

Aproximadamente 90% dos chips mais avançados do mundo são fabricados por uma única empresa, em uma única ilha.

A empresa é a TSMC (Taiwan Semiconductor Manufacturing Company).

A ilha é Taiwan — que fica a 160 quilômetros da China continental.

Sem a TSMC, a Apple não teria iPhones. A NVIDIA não teria GPUs de IA. A AMD não teria processadores. Praticamente toda a cadeia de inovação tecnológica do planeta passa por esse único ponto geográfico.

É a concentração de risco mais extrema da história industrial moderna.

Em resposta, os EUA, a UE e o Japão lançaram iniciativas bilionárias para trazer a produção de chips de volta a seus territórios:

🇺🇸 CHIPS and Science Act (EUA, 2022) US$ 52 bilhões em subsídios diretos. Intel, TSMC e Samsung anunciaram fábricas nos EUA. Problema: a fábrica da TSMC no Arizona atrasou mais de um ano por falta de engenheiros qualificados.

🇪🇺 European Chips Act (2023) €43 bilhões para dobrar a participação europeia no mercado global de chips (de 10% para 20%) até 2030. Problema: meta considerada ambiciosa demais pelos próprios analistas do setor.

🇯🇵 Japão Atraiu a TSMC para construir fábrica em Kumamoto, com contribuição de ¥476 bilhões. Uma segunda fábrica foi anunciada logo depois.

Os EUA implementaram restrições progressivas à exportação de chips avançados para a China — especificamente GPUs de alta performance da NVIDIA. A justificativa oficial: impedir uso militar.

O efeito colateral foi o oposto do pretendido.

A China acelerou brutalmente seus investimentos em capacidade doméstica de chips. A Huawei lançou o chip Ascend 910B tentando preencher a lacuna. A SMIC (Semiconductor Manufacturing International Corporation) está escalando capacidade. Em dezembro de 2024 e 2025, autoridades americanas indiciaram uma rede que tentou exportar ilegalmente US$ 160 milhões em GPUs NVIDIA H100 e H200 para a China.

Ao tentar frear o adversário, os controles de exportação aceleraram exatamente a capacidade que tentavam monopolizar.

Aqui está uma comparação que ajuda a entender a escala:

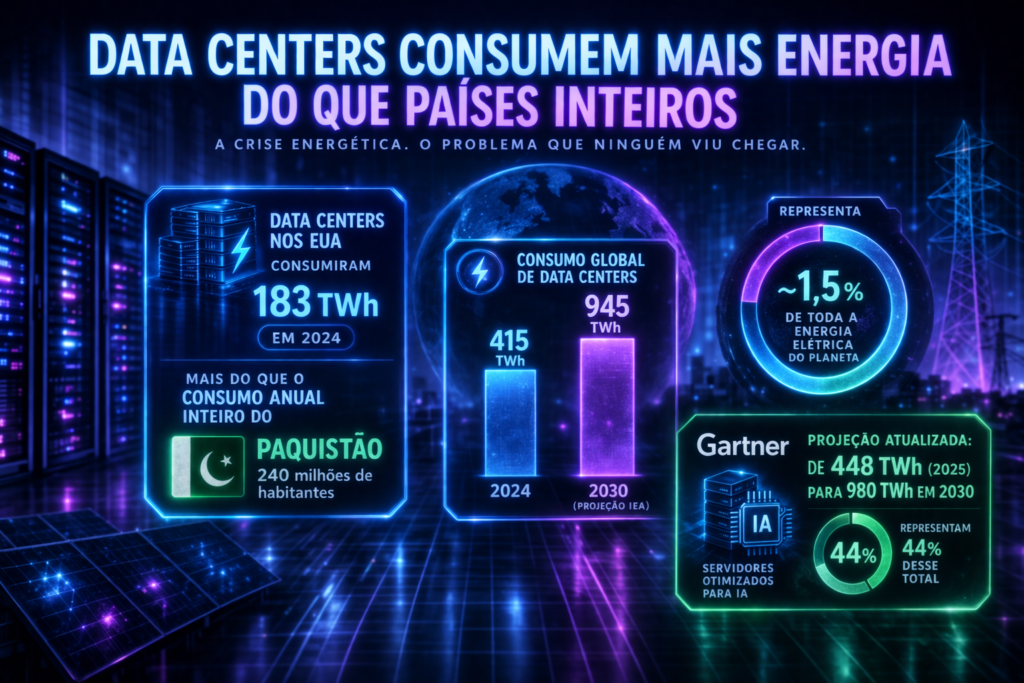

🌍 Data centers americanos consumiram 183 TWh de eletricidade em 2024. Isso é mais do que o consumo anual inteiro do Paquistão — país com 240 milhões de habitantes.

Globalmente, data centers consumiram 415 TWh em 2024 — cerca de 1,5% de toda a energia elétrica do planeta.

A Agência Internacional de Energia (IEA) projeta que esse número vai quase dobrar para 945 TWh até 2030.

O Gartner vai além: estima crescimento de 448 TWh (2025) para 980 TWh em 2030, com servidores otimizados para IA representando 44% desse total.

O condado de Loudoun, na Virgínia, é o maior cluster de data centers dos EUA.

Em 2023, ele sozinho respondeu por 21% do consumo de energia elétrica de todo o estado da Virgínia.

Mais do que toda a população residencial do estado.

Em um incidente de 2024, uma falha menor na rede elétrica da região fez 60 data centers mudarem simultaneamente para geradores de backup — causando uma perda instantânea de 1.500 megawatts. O equivalente a desligar a cidade de Boston de uma vez.

As big techs não estão pagando essa conta sozinhas.

Na região do PJM — o maior operador de rede elétrica dos EUA, cobrindo de Illinois à Carolina do Norte — data centers contribuíram para um aumento de US$ 9,3 bilhões no mercado de capacidade elétrica.

O impacto nas contas residenciais:

A Universidade Carnegie Mellon estima que data centers podem aumentar a conta elétrica média americana em 8% até 2030 — com picos acima de 25% nas regiões de maior concentração.

Treinar um único modelo de linguagem de grande escala como o GPT-4 gerou estimadamente 552 toneladas de CO₂.

É a pegada anual de 121 famílias americanas — para um único ciclo de treinamento de um único modelo.

E o treinamento é a parte mais fácil: a inferência (fazer o modelo responder seus prompts, 24/7, para milhões de usuários) pode representar até 90% do ciclo de vida energético total de um modelo.

Cada vez que você pede ao ChatGPT para escrever um e-mail, um micro fragmento dessa conta energética existe.

Diante disso, as maiores empresas de tecnologia do mundo estão fazendo uma aposta incomum: energia nuclear.

Não é coincidência. É uma corrida.

Em 2024, quatro empresas investiram juntas mais de US$ 200 bilhões em infraestrutura de IA:

| Empresa | CapEx 2024 | Variação vs 2023 |

|---|---|---|

| Amazon (AWS) | US$ 85,8 bi | +78% |

| US$ 52,5 bi | +63% | |

| Microsoft | US$ 44,5 bi | +58% |

| Meta | US$ 39,2 bi | +40% |

Para 2025, a Amazon projeta ultrapassar US$ 100 bilhões sozinha.

A Bain & Company projeta que a demanda por infraestrutura de IA vai exigir US$ 2 trilhões anuais até 2030 — com um gap de US$ 800 bilhões entre o que está sendo investido e o que seria necessário.

Quer construir um modelo competitivo com os líderes de mercado hoje?

Você vai precisar de:

A IA de fronteira está se tornando um oligopólio.

Não por escolha. Por física e economia.

Mas há um contraponto importante.

Em janeiro de 2025, uma startup chinesa praticamente desconhecida — a DeepSeek — lançou o modelo R1.

Performance comparável ao OpenAI o1. Custo de treinamento estimado em US$ 5 a 6 milhões — fração ínfima do que os modelos concorrentes custaram.

O impacto foi imediato: ações da NVIDIA caíram quase 17% em um único dia, apagando US$ 600 bilhões de valor de mercado — a maior perda de valor de mercado em um dia para uma empresa na história.

A mensagem do mercado foi clara: se a eficiência algorítmica pode reduzir drasticamente a necessidade de hardware, o monopólio do silício tem um limite.

O movimento de open source em IA — com modelos como o LLaMA da Meta e o próprio DeepSeek disponíveis publicamente — sugere que democratização é possível mesmo quando infraestrutura segue concentrada.

O silício não é a única opção. É apenas a mais madura.

Computação fotônica Usa fótons (luz) em vez de elétrons. Empresas como Lightmatter e Ayar Labs prometem consumo energético ordens de magnitude menor. A Lightmatter levantou mais de US$ 400 milhões e está em negociações com grandes fabricantes.

Chips neuromórficos Inspirados na arquitetura do cérebro humano. A Intel Loihi e projetos universitários exploram essa abordagem para tipos específicos de inferência em tempo real — especialmente eficiente para sinais contínuos, como sensores.

Computação em memória (In-Memory Computing) Move o processamento para onde os dados ficam, eliminando o gargalo de largura de banda. Pode mudar fundamentalmente o design de aceleradores de IA.

O caso extremo: Cerebras A startup Cerebras Systems construiu o maior chip já fabricado: o Wafer Scale Engine — do tamanho de um wafer inteiro de silício (46.225 mm²), com 4 trilhões de transistores. A ideia: eliminar a latência de comunicação entre chips, um dos principais gargalos em clusters convencionais.

Em vez de tudo na nuvem, o processamento local está ganhando força.

Pense no Apple M4: roda modelos de linguagem localmente, com eficiência energética que data centers de grande escala ainda não conseguem igualar para cargas de trabalho específicas.

Benefícios do edge AI:

A tendência mais poderosa não é construir chips melhores. É precisar de menos chips.

Quantização Reduz a precisão numérica dos pesos (de 32 bits para 8, 4 ou até 2 bits). Resultado: modelos que cabem em hardware doméstico com impacto mínimo na qualidade. Pode reduzir necessidades de GPU em 30% a 70%.

Destilação de modelos Um modelo grande “ensina” um modelo menor, transferindo conhecimento de forma comprimida. O modelo menor fica surpreendentemente capaz com fração dos recursos.

Misturas de especialistas (MoE) Apenas uma fração dos parâmetros do modelo é ativada para cada inferência. O resto fica “dormindo”. Resultado: modelos com bilhões de parâmetros totais, mas custo computacional de modelos muito menores.

Em março de 2026, o Google anunciou o TurboQuant — tecnologia de compressão de memória para LLMs que alega 6x menos memória e 8x mais performance em aceleradores H100.

O Brasil está em uma posição de dupla vulnerabilidade.

Sem fábricas domésticas de semicondutores avançados e sem políticas robustas de desenvolvimento de chips, o país depende integralmente de importações para toda a cadeia.

Os fatores que amplificam a crise no Brasil:

| Fator | Impacto |

|---|---|

| Impostos de importação sobre hardware | Custo final muito mais alto do que em mercados desenvolvidos |

| Depreciação cambial | Cada aumento em dólares é amplificado em reais |

| Dependência de hidrelétricas | Custo energético com alta variabilidade por secas |

| Data centers concentrados nos EUA | Latência maior, custos de conectividade |

O resultado prático: enquanto grandes empresas como o Itaú (R$ 3,5 bilhões investidos em IA em 2024) e a Petrobras têm orçamentos que absorvem esses custos, startups e pesquisadores acadêmicos enfrentam barreiras de acesso crescentes.

A desigualdade tecnológica não é apenas global — é também nacional.

Novas fábricas entram em operação a partir de 2027-2028. Técnicas de eficiência reduzem demanda por hardware de ponta. Concorrência entre NVIDIA, AMD, startups e chips proprietários normaliza preços.

A IA continua avançando, de forma mais distribuída e acessível.

Custo de entrada permanece proibitivo para a maioria. Google, Microsoft/OpenAI, Amazon e Meta consolidam domínio sobre modelos de fronteira. Modelos open source eficientes existem, mas o estado da arte real fica concentrado em quem tem acesso privilegiado à infraestrutura.

A IA avança, mas a distância entre líderes e o resto cresce.

Tensões geopolíticas em Taiwan, gargalos energéticos persistentes e custos crescentes desaceleram materialmente o ritmo de avanço. A lei dos rendimentos decrescentes nos LLMs, combinada com escassez de hardware, faz o próximo salto qualitativo demorar muito mais do que o mercado espera.

O hype dá lugar a uma recessão de expectativas — e de investimentos.

A crise do hardware não é o fim da inteligência artificial.

É o fim da ilusão de que a IA avançaria sem fricção com o mundo físico.

Chips precisam ser fabricados em fábricas que custam dezenas de bilhões. Memórias exigem materiais raros processados por monopólios japoneses. Data centers precisam de energia equivalente a cidades inteiras. E toda essa cadeia passa por ilhas geograficamente vulneráveis, relações comerciais politicamente frágeis e restrições físicas que nenhuma linha de código pode resolver.

Nas próximas décadas, os maiores determinantes do progresso tecnológico podem não ser os pesquisadores de IA.

Podem ser os engenheiros de semicondutores. Os planejadores de redes elétricas. Os diplomatas que negociam acordos de comércio de chips.

A era do hardware como variável estratégica começou.

E quem entender isso antes vai estar muito melhor posicionado — como investidor, como empresa, como país.

GPU — Chip originalmente criado para gráficos de videogame, hoje o principal acelerador de IA.

HBM (High-Bandwidth Memory) — Memória ultrarrápida usada em aceleradores de IA, produzida em camadas verticais.

TSMC — Taiwan Semiconductor Manufacturing Company. A maior e mais avançada fundição de chips do mundo.

CoWoS — Tecnologia da TSMC para integrar GPUs e memórias HBM em um único módulo funcional.

CapEx — Capital Expenditure. Investimento em ativos físicos: fábricas, data centers, infraestrutura.

Quantização — Técnica de compressão de modelos que reduz o tamanho dos pesos para economizar memória e computação.

SMR — Small Modular Reactor. Reator nuclear de pequena escala, aposta das big techs para energia limpa de data centers.

Lei de Moore — Observação de 1965 de Gordon Moore (Intel) de que transistores em chips dobram a cada dois anos.

CoWoS — Chip-on-Wafer-on-Substrate. Packaging avançado que integra múltiplos chips em um módulo.

Não completamente, mas desacelerou de forma estrutural. A TSMC ainda está desenvolvendo processos de 2nm e 1,6nm. Mas os ganhos por geração são menores, e os custos de cada avanço crescem exponencialmente. A era de melhorias “de graça” a cada dois anos acabou.

Pela combinação de hardware superior com o ecossistema CUDA — bilhões de linhas de código de clientes escritas para hardware NVIDIA ao longo de quase 20 anos. Migrar exige reescrever esse código: custoso, demorado e arriscado. É um fosso competitivo construído durante décadas.

Parcialmente. Demonstrou que eficiência algorítmica pode reduzir drasticamente custos de treinamento e inferência. Mas não elimina a necessidade de hardware de ponta para modelos de fronteira — apenas reduz quanto hardware é necessário por unidade de capacidade. É progresso, não solução.

Novas fábricas devem entrar em operação entre 2027 e 2028. Para memória HBM e packaging avançado, o gargalo pode persistir além disso. Não há solução de curto prazo estrutural — apenas gerenciamento de escassez.

Os dois e ao mesmo tempo. Para treinar modelos, chips e memória são o gargalo imediato. Para operar data centers em escala, energia está emergindo como o limitador crítico de longo prazo. Um alimenta o outro — e os dois estão em crise simultânea.

Não de forma estrutural. O país não possui capacidade doméstica de chips avançados, depende totalmente de importações e enfrenta amplificação cambial de todos os custos. A desigualdade de acesso à infraestrutura de IA entre Brasil e países líderes está crescendo, não diminuindo.

Para aprofundar na crise do hardware para IA, consulte fontes autorizadas com dados de 2024-2026 sobre escassez de chips, energia e geopolítica.

🤖 Manus AI: a IA que faz o trabalho por você (guia definitivo)

Uma análise completa da Manus AI, a nova geração de agentes autônomos que executam tarefas complexas de ponta a ponta — e o que isso significa para produtividade e trabalho digital.

🧠 DeepSeek V4: a IA chinesa que quer acabar com a amnésia dos robôs

Entenda como a DeepSeek está redefinindo memória em modelos de IA e por que isso pode mudar o equilíbrio global na corrida tecnológica.

⚙️ n8n: o guia completo da plataforma que está redefinindo a automação com IA

Um mergulho profundo na ferramenta que combina automação e inteligência artificial, permitindo criar fluxos poderosos sem depender de código complexo.

📌 Artigo SPTechBR | Atualizado: março de 2026 Slug: crise-do-hardware-ia | Palavra-chave: crise do hardware Meta descrição: A crise do hardware está limitando a IA. Chips escassos, energia cara, geopolítica e memória HBM formam o gargalo invisível que pode travar a próxima década da inteligência artificial. Tags: inteligência artificial, hardware, GPUs, NVIDIA, TSMC, data centers, energia, semicondutores, transformação digital

🚀 Receba análises profundas sobre tecnologia e IA

A inteligência artificial está evoluindo rápido — mas os verdadeiros movimentos estão acontecendo nos bastidores: chips, energia, geopolítica e infraestrutura.

Toda semana, enviamos uma análise clara, direta e sem hype sobre o que realmente importa no futuro da tecnologia.

📩 Entre para a newsletter do SPTechBR e fique à frente:

👉 Assine gratuitamente e acompanhe de perto a transformação da tecnologia.