Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

O ecossistema de IA do Google se tornou um dos projetos tecnológicos mais ambiciosos da história recente da inteligência artificial. Com modelos como Gemini, ferramentas criativas como Veo e uma infraestrutura massiva de data centers e chips próprios, a empresa está construindo uma plataforma completa para a era da IA.

A corrida pela supremacia da inteligência artificial chegou em 2025 a um patamar que transcende a competição por modelos mais rápidos e respostas mais precisas. O que está sendo disputado agora é algo muito maior: o controle sobre a infraestrutura que vai definir como bilhões de pessoas trabalham, criam, buscam informação e interagem com máquinas nas próximas décadas. E o Google — uma empresa que, paradoxalmente, foi pega de surpresa pelo lançamento do ChatGPT em 2022 — ressurgiu como um dos jogadores mais imponentes desta corrida, com uma proposta que vai além de qualquer produto isolado.

Sundar Pichai, CEO da Alphabet, descreveu internamente o ritmo de investimentos em IA como “brutal”. Não é metáfora. A empresa projetou gastar entre US$ 175 bilhões e US$ 185 bilhões em infraestrutura apenas em 2026 — quase o dobro dos US$ 91,4 bilhões investidos em 2025 e um salto vertiginoso em relação aos US$ 52,5 bilhões de 2024. Para se ter perspectiva: esse valor supera o PIB de países como Portugal, Finlândia ou Nova Zelândia.

Mas dinheiro sozinho não explica o que o Google está construindo. A estratégia é mais sofisticada e mais ambiciosa do que uma simples injeção de capital em servidores e chips. O Google está montando, peça por peça, o que pode se tornar o sistema operacional da era da inteligência artificial — uma plataforma de camadas múltiplas que conecta modelos de linguagem, ferramentas criativas, infraestrutura de agentes, APIs corporativas e aplicações de uso final em um ecossistema tão integrado que, para quem entrar, será difícil sair.

Este artigo analisa em profundidade cada componente dessa arquitetura: os modelos, as ferramentas de criação, os agentes autônomos, os investimentos financeiros, os concorrentes e, acima de tudo, o que está em jogo geopoliticamente nessa batalha que vai muito além do Silicon Valley.

Para entender o que o Google está fazendo, é preciso compreender que a guerra da inteligência artificial não está mais sendo travada no mesmo campo de batalha de 2022 e 2023.

A primeira fase da corrida foi caracterizada pela emergência dos grandes modelos de linguagem. O lançamento do ChatGPT pela OpenAI em novembro de 2022 foi o gatilho que deflagrou uma disputa global por quem conseguia treinar o modelo mais capaz, mais rápido e mais barato. Google respondeu com Bard e, logo depois, com Gemini. A Anthropic lançou Claude. A Meta liberou o Llama. A Mistral surgiu da Europa como alternativa open source. Era a era dos “modelos fundacionais” — e o critério de sucesso era relativamente simples: benchmarks de desempenho em raciocínio, codificação e compreensão de linguagem.

O campo de batalha mudou. A segunda fase, que vivemos agora em 2026, é sobre ecossistemas — sobre quem consegue integrar modelos, ferramentas, infraestrutura, agentes e aplicações em um conjunto coeso que cria dependência de uso, gera receita recorrente e dificulta a migração dos usuários para plataformas concorrentes.

Ter um modelo poderoso deixou de ser suficiente. É necessário ter também as ferramentas que os desenvolvedores usam para construir aplicações sobre esse modelo, os protocolos que permitem que agentes autônomos se comuniquem entre si, a infraestrutura de nuvem que hospeda tudo isso e as aplicações de produtividade que levam a IA até o usuário final — sem que ele precise entender nada da camada técnica embaixo.

O Google, com sua história de mais de 25 anos construindo plataformas — Search, Android, YouTube, Gmail, Google Cloud — tem um DNA singular para jogar esse tipo de jogo. A questão é se consegue executar com a velocidade que o momento exige.

Antes de detalhar cada produto, é útil entender o conceito de “AI stack” — a pilha de tecnologia que compõe um ecossistema de IA. Pense como uma torre de andares, onde cada camada depende das anteriores e habilita as seguintes.

A primeira camada é a dos modelos de base — os grandes modelos de linguagem e multimodais que realizam o processamento central. A segunda camada é a das ferramentas de criação — interfaces e APIs que permitem a usuários e desenvolvedores interagir com esses modelos para criar conteúdo, código ou análises. A terceira camada é a infraestrutura de desenvolvimento — os chips (TPUs no caso do Google), os data centers, as redes de distribuição e os ambientes de desenvolvimento que sustentam tudo. A quarta camada é a dos agentes autônomos — sistemas que não apenas respondem a perguntas, mas executam tarefas em sequência, tomam decisões e interagem com outros agentes ou APIs externas. A quinta camada é a das aplicações finais — produtos como Google Search, Gmail, Google Workspace, Google Ads e YouTube que chegam ao usuário sem expor a complexidade técnica das camadas abaixo.

O Google hoje opera com presença relevante em todas essas camadas. É uma vantagem estrutural que poucos concorrentes têm em igual extensão.

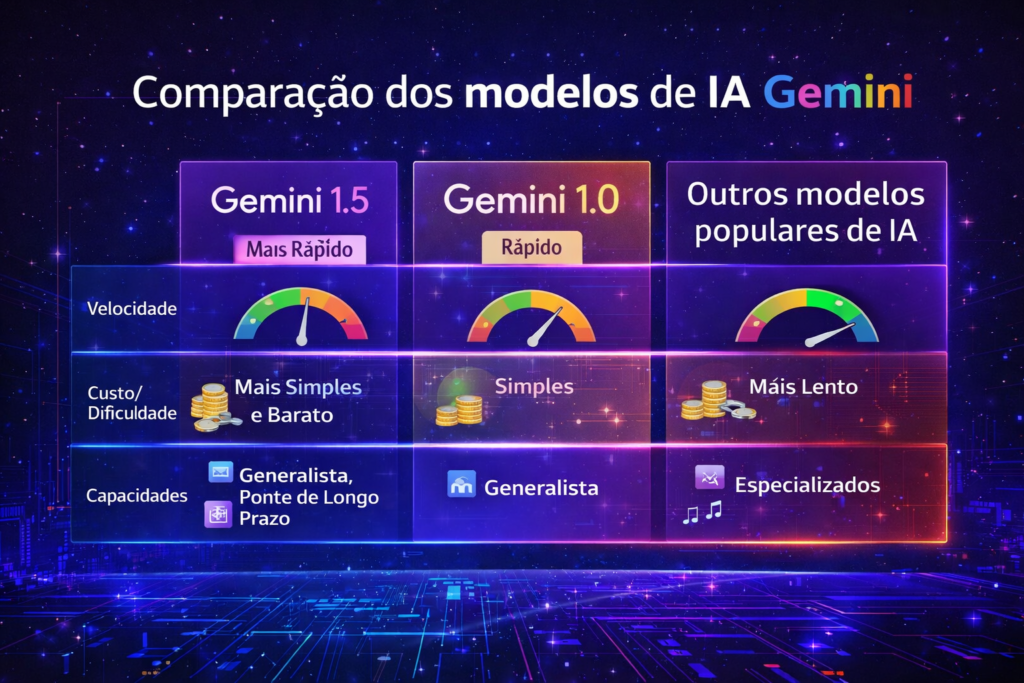

O Gemini Flash é o modelo projetado para uso em volume. Sua função principal não é impressionar em benchmarks de raciocínio avançado — é entregar respostas rápidas, com custo de inferência baixo, em aplicações que precisam de resposta em tempo real. Pense em chatbots de atendimento ao cliente, assistentes embutidos em aplicativos mobile, sugestões automáticas em editores de texto, classificação de documentos em larga escala.

A lógica econômica por trás do Flash é poderosa: ao reduzir dramaticamente o custo por consulta, o Google consegue oferecer IA em contextos onde antes o custo proibia a viabilidade do produto. A empresa afirmou ter reduzido o custo unitário de servir consultas ao Gemini em aproximadamente 78% ao longo de 2025, graças a otimizações nos TPUs e eficiência nos data centers — uma queda que transforma a equação de viabilidade para inúmeras categorias de aplicações.

O Flash Lite vai um passo além: é a versão ultraleve da família, projetada para rodar em ambientes com recursos computacionais ainda mais restritos — dispositivos de borda, aplicações com orçamento de inferência mínimo, integrações em escala massiva onde bilhões de chamadas precisam acontecer com custo próximo de zero. É o modelo que habilita a IA em contextos que nem existiam como mercado viável há dois anos.

O Gemini Pro é onde a família Gemini concorre diretamente com GPT-4o da OpenAI e com Claude Opus da Anthropic. É o modelo para tarefas que exigem raciocínio profundo, análise de problemas complexos, síntese de grandes volumes de informação, geração de código sofisticado, planejamento estratégico e interpretação de documentos técnicos.

O Pro é também o modelo que alimenta o Google AI Studio e as APIs premium no Vertex AI, a plataforma de desenvolvimento em nuvem do Google. Com uma janela de contexto expandida — a empresa trabalha com janelas que podem processar volumes enormes de texto em uma única interação — o Gemini Pro habilita casos de uso corporativos onde documentos inteiros, bases de dados históricas ou repositórios de código precisam ser processados sem fragmentação.

O Gemini Deep Research é uma especialização do modelo para tarefas de pesquisa aprofundada. Em vez de responder perguntas simples, ele é capaz de conduzir investigações em múltiplas etapas, consultar fontes diversas, sintetizar contradições, identificar lacunas de informação e produzir relatórios estruturados. É a IA que começa a substituir partes do trabalho de analistas, pesquisadores de mercado e consultores.

A integração com o Google Search — que ainda indexa mais da internet do que qualquer outro mecanismo do mundo — confere ao Deep Research uma vantagem de acesso a informação que nenhum concorrente puro de IA consegue replicar com a mesma abrangência.

A família Gemma é a resposta do Google à Meta e à Mistral no universo open weights. São modelos menores, leves, que podem ser baixados e rodados localmente por qualquer empresa ou desenvolvedor sem depender de APIs do Google. A estratégia é inteligente e paradoxal: ao liberar modelos abertos poderosos, o Google diminui a barreira de adoção da sua tecnologia e constrói goodwill na comunidade de desenvolvedores — que eventualmente podem migrar para modelos maiores pagos ou usar Google Cloud para rodá-los em escala.

O Gemma concorre diretamente com o Llama 3 da Meta e com os modelos da Mistral, e tem sido adotado em aplicações de pesquisa acadêmica, prototipagem de produtos e implementações corporativas onde privacidade ou latência proíbem o uso de APIs externas.

Uma das apostas mais disruptivas do Google está na geração de vídeo com inteligência artificial — uma área que promete reorganizar completamente as indústrias criativas globais.

O Veo é o modelo de geração de vídeo do Google, concorrente direto do Sora da OpenAI, do Runway e do Pika. A versão 3.1 representa um avanço significativo em fidelidade visual, coerência temporal — a capacidade de manter consistência de objetos, personagens e iluminação ao longo dos frames — e controle criativo.

O que torna o Veo estrategicamente importante não é apenas a qualidade do vídeo gerado. É o fato de que o Google tem uma distribuição incomparável: o YouTube é a maior plataforma de vídeo do mundo, com mais de 2,7 bilhões de usuários mensais. A integração futura do Veo com o YouTube Creator Studio poderia transformar a criação de conteúdo em um processo radicalmente diferente — onde criadores geram versões alternativas de cenas, criam b-roll automaticamente ou produzem conteúdo em múltiplos idiomas com pouco esforço adicional.

Flow é uma ferramenta focada na criação de narrativas visuais cinematográficas. Vai além da geração de clipes isolados: permite estruturar cenas, controlar a progressão narrativa e criar sequências com continuidade de estilo e elementos visuais. É voltado para criadores que precisam de consistência na identidade visual — diretores de arte, produtores de conteúdo, roteiristas que querem visualizar storyboards com rapidez.

A ferramenta sinaliza uma direção importante: a IA generativa de vídeo está deixando de ser um brinquedo de demonstração para se tornar parte do fluxo de trabalho criativo profissional.

O Google Vids é a versão enterprise da criação de vídeo com IA, integrada ao Google Workspace. Seu foco são as necessidades corporativas cotidianas: criar apresentações em vídeo, vídeos de treinamento interno, materiais de marketing e comunicações institucionais. Elimina a necessidade de ferramentas externas de edição para a maioria dos casos corporativos comuns e democratiza a produção de vídeo profissional para equipes sem orçamento para produção audiovisual dedicada.

O Stitch é uma das ferramentas mais intrigantes do portfólio do Google. Sua proposta é transformar descrições em linguagem natural em interfaces de aplicativos completas — layouts, componentes visuais, fluxos de interação. Para designers de UX/UI e times de produto, representa uma aceleração dramática na fase de prototipagem: em vez de semanas em ferramentas de design, um primeiro protótipo navegável pode emergir em minutos.

A implicação de longo prazo é significativa para a indústria de design de software. Ferramentas como Figma ainda dominam o fluxo profissional, mas o Stitch anuncia um futuro onde a barreira de entrada para criar interfaces de produto cai radicalmente — democratizando a criação de apps e desafiando modelos de negócio de toda uma cadeia de ferramentas de design.

O Whisk é uma ferramenta de exploração criativa baseada em imagem. Recebe imagens como entrada e as transforma em variações visuais, conceitos alternativos e direcionamentos estéticos. É voltado para o início do processo criativo — a fase de brainstorming visual, onde designers e diretores de arte precisam explorar possibilidades antes de comprometer recursos com produção.

A diferença do Whisk em relação a ferramentas genéricas de geração de imagem está na orientação para o processo de design: não é sobre gerar uma imagem bonita, mas sobre explorar direções conceituais com velocidade.

O Nanobanana é uma ferramenta de geração de imagens construída sobre a arquitetura do Gemini, aproveitando o entendimento contextual profundo do modelo para produzir imagens mais alinhadas com briefings complexos — descrições com múltiplas condições, restrições de estilo, referências culturais e nuances de tom. É especialmente relevante para marketing e branding, onde a coerência com identidades visuais estabelecidas é crítica.

![[H2] Pesquisa e organização do conhecimento: NotebookLM e além

[H3] NotebookLM: o assistente de pesquisa mais sofisticado do mercado

O NotebookLM é possivelmente a ferramenta do ecossistema Google que mais ilustra o potencial transformador da IA aplicada ao trabalho intelectual. Sua proposta é simples na superfície e revolucionária na prática: o usuário carrega seus próprios documentos — PDFs, artigos, notas, transcrições, planilhas — e o NotebookLM se torna um assistente especialista naquele corpus específico.

Diferente de um chatbot genérico que responde com base em treinamento geral, o NotebookLM fundamenta todas as suas respostas nas fontes fornecidas pelo usuário. Cita passagens, aponta contradições entre documentos, sugere conexões não óbvias entre tópicos e gera sumários estruturados. Para pesquisadores, analistas de dados, jornalistas investigativos, estudantes e qualquer profissional que trabalha com grandes volumes de informação, é uma mudança fundamental na relação com o conhecimento acumulado.

Em 2025, o NotebookLM evoluiu para suportar casos de uso coletivos — equipes podem criar bases de conhecimento compartilhadas que funcionam como consultores especializados na documentação interna da organização. Uma empresa que alimenta o NotebookLM com seus manuais, relatórios históricos e bases de cliente cria, efetivamente, um especialista institucional disponível 24 horas.

[H3] Pomelli: ideação criativa e planejamento de conteúdo

O Pomelli é uma ferramenta voltada para o planejamento criativo, especialmente no contexto de marketing digital e estratégia de conteúdo. Gera ideias de campanhas, sugere ângulos narrativos, cria calendários de publicação e propõe variações de mensagem para diferentes audiências e plataformas. É a IA como parceiro de brainstorming para times de comunicação e marketing — não substituindo o estrategista criativo, mas acelerando o tempo entre o briefing e as primeiras ideias acionáveis.](https://sptechbr.com/wp-content/uploads/2026/03/ChatGPT-Image-21-de-mar.-de-2026-13_16_23-1024x683.png)

O NotebookLM é possivelmente a ferramenta do ecossistema Google que mais ilustra o potencial transformador da IA aplicada ao trabalho intelectual. Sua proposta é simples na superfície e revolucionária na prática: o usuário carrega seus próprios documentos — PDFs, artigos, notas, transcrições, planilhas — e o NotebookLM se torna um assistente especialista naquele corpus específico.

Diferente de um chatbot genérico que responde com base em treinamento geral, o NotebookLM fundamenta todas as suas respostas nas fontes fornecidas pelo usuário. Cita passagens, aponta contradições entre documentos, sugere conexões não óbvias entre tópicos e gera sumários estruturados. Para pesquisadores, analistas de dados, jornalistas investigativos, estudantes e qualquer profissional que trabalha com grandes volumes de informação, é uma mudança fundamental na relação com o conhecimento acumulado.

Em 2025, o NotebookLM evoluiu para suportar casos de uso coletivos — equipes podem criar bases de conhecimento compartilhadas que funcionam como consultores especializados na documentação interna da organização. Uma empresa que alimenta o NotebookLM com seus manuais, relatórios históricos e bases de cliente cria, efetivamente, um especialista institucional disponível 24 horas.

O Pomelli é uma ferramenta voltada para o planejamento criativo, especialmente no contexto de marketing digital e estratégia de conteúdo. Gera ideias de campanhas, sugere ângulos narrativos, cria calendários de publicação e propõe variações de mensagem para diferentes audiências e plataformas. É a IA como parceiro de brainstorming para times de comunicação e marketing — não substituindo o estrategista criativo, mas acelerando o tempo entre o briefing e as primeiras ideias acionáveis.

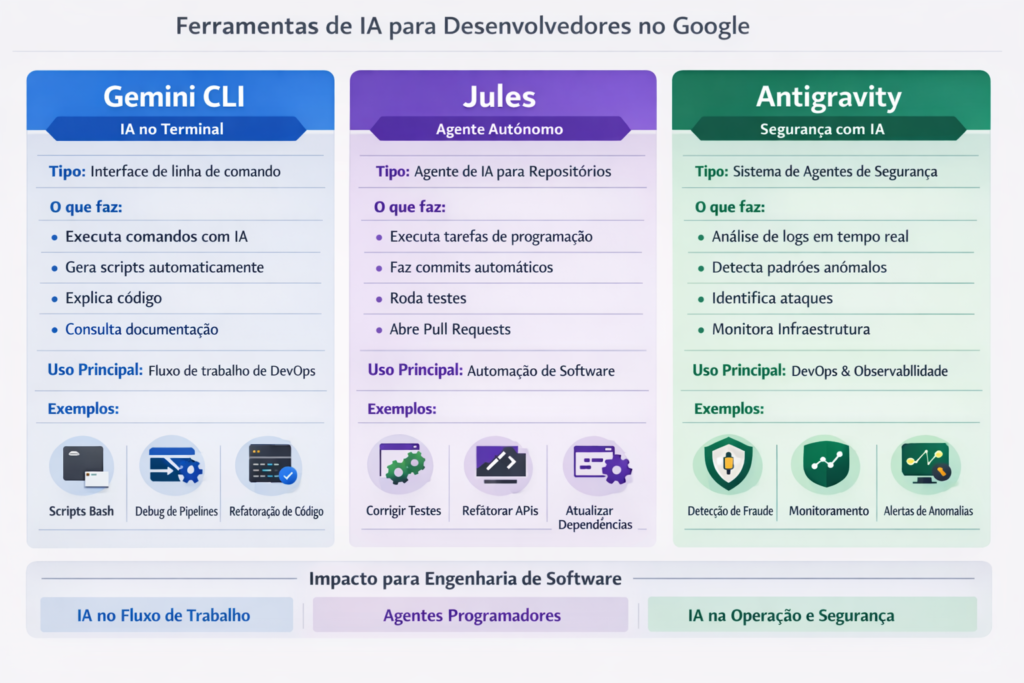

O Gemini CLI é a interface de linha de comando para os modelos Gemini — uma decisão estratégica que posiciona o Google diretamente no fluxo de trabalho de desenvolvedores, DevOps e engenheiros de dados. Em vez de exigir que o desenvolvedor saia do seu ambiente de trabalho para interagir com a IA, o Gemini CLI traz os modelos para dentro do terminal.

As aplicações são vastas: geração de scripts de automação, depuração de pipelines de dados, consultas a documentações técnicas sem sair do ambiente de trabalho, geração de testes unitários, sugestões de refatoração de código. Para times de engenharia, é a diferença entre a IA como ferramenta complementar e a IA como parceiro integrado ao fluxo de desenvolvimento.

Jules é um agente de programação assíncrono projetado para trabalhar com repositórios de código. Sua proposta vai além de sugestões de linha a linha, como faz o GitHub Copilot: Jules pode receber uma tarefa descrita em linguagem natural — “corrija todos os testes que estão falhando no módulo de autenticação” ou “refatore a API de pagamentos para usar o padrão REST” — e executá-la de forma autônoma, fazendo commits, rodando testes e reportando o resultado.

A integração prevista com GitHub e plataformas de Git empresariais transforma Jules em um membro virtual da equipe de engenharia — que nunca dorme, nunca reclama de tarefas repetitivas e pode trabalhar em paralelo em múltiplas branches. É a materialização mais clara do conceito de “agente de IA” no contexto de desenvolvimento de software.

O Antigravity é um sistema baseado em agentes para detecção de anomalias e monitoramento de segurança. Em vez de regras estáticas de alerta, usa modelos de IA para identificar padrões de comportamento anômalo em sistemas complexos — relevante para segurança de infraestrutura, detecção de fraudes, monitoramento de performance e auditoria de conformidade.

É a IA aplicada à camada de operações — onde a automação e a capacidade de processar volumes massivos de logs e eventos em tempo real pode fazer a diferença entre detectar uma intrusão em minutos ou em dias.

Esta é, provavelmente, a parte mais estratégica e menos compreendida do ecossistema do Google. A camada de agentes não é sobre ferramentas que respondem perguntas — é sobre sistemas que executam tarefas complexas, em múltiplas etapas, interagindo com outros sistemas e tomando decisões ao longo do caminho.

O Google ADK é um framework para o desenvolvimento de agentes de IA — sistemas autônomos que podem ser programados para executar sequências de tarefas, chamar APIs externas, tomar decisões condicionais e interagir com usuários ou outros agentes. Pense no ADK como o Django ou o Rails do mundo dos agentes: uma estrutura que elimina a complexidade de construir agentes do zero e permite que desenvolvedores foquem na lógica de negócio específica que querem automatizar.

A importância estratégica do ADK vai além da conveniência do desenvolvedor: ao se tornar o framework padrão para construção de agentes, o Google cria dependência técnica em uma camada crítica. Empresas que constroem agentes com o ADK estão, de certa forma, alugando não apenas o modelo, mas toda a infraestrutura conceitual de como seus agentes funcionam.

O A2A é um protocolo de comunicação entre agentes — talvez o componente mais visionário e menos visível do portfólio do Google. Sua função é permitir que agentes de IA diferentes — construídos por empresas diferentes, para finalidades diferentes — consigam se comunicar de forma padronizada e executar tarefas em colaboração.

Imagine um agente de calendário que precisa coordenar com um agente de viagens, que por sua vez precisa se comunicar com um agente de aprovação de despesas, que consulta um agente de conformidade tributária. Sem um protocolo padronizado, cada integração é um projeto de desenvolvimento separado. Com o A2A, todas essas comunicações ocorrem em uma linguagem comum.

Se o A2A for adotado como padrão pela indústria — algo que o Google está ativamente incentivando, inclusive com suporte ao Model Context Protocol (MCP) da Anthropic — o Google se posiciona como a empresa que definiu o DNS dos agentes de IA. Quem define o protocolo define as regras do ecossistema.

A FileSearch API permite que desenvolvedores construam sistemas de busca semântica sobre suas próprias bases de dados usando técnicas de RAG (Retrieval-Augmented Generation) — a abordagem que conecta modelos de linguagem a fontes de dados externas, em vez de confinar o conhecimento ao treinamento estático do modelo.

Para uma empresa de seguros, isso significa um agente que pode consultar o histórico completo de apólices de um cliente antes de responder uma pergunta. Para um hospital, um assistente que busca literatura médica específica antes de sugerir protocolos de tratamento. O RAG é o elo que conecta a inteligência geral do modelo à inteligência específica do contexto de negócio de cada organização.

O AI Mode é a evolução mais visível para o usuário final — uma transformação do Google Search de um mecanismo de links para um assistente de pesquisa multimodal completo. Em vez de retornar uma lista de páginas, o AI Mode interpreta a intenção por trás da busca, sintetiza informações de múltiplas fontes, executa raciocínio em múltiplas etapas (query fan-out) e entrega respostas estruturadas com contexto.

A integração com Project Astra — o sistema de percepção visual em tempo real do Google — adiciona uma camada nova: a busca por imagem ao vivo, onde o usuário pode apontar a câmera para um objeto, um plato de comida, um documento, e receber análise imediata. É a fusão de busca, visão computacional e raciocínio de linguagem em um único fluxo de interação.

Um dos ativos mais subestimados do Google na guerra da IA é a sua família de chips proprietários, os Tensor Processing Units (TPUs). A sétima geração, o Ironwood, começou a disponibilidade geral em 2025 e representa uma vantagem de performance por watt que os concorrentes não conseguem replicar facilmente — já que dependem majoritariamente de GPUs da NVIDIA.

Os TPUs não são apenas uma economia de custo. São uma vantagem de soberania tecnológica: ao controlar seus próprios chips, o Google não está sujeito às restrições de fornecimento, aos preços e às prioridades de alocação que afetam todos os outros players que dependem de NVIDIA. Em um cenário geopolítico onde chips de IA estão sujeitos a controles de exportação e tensões de cadeia de suprimentos, essa independência tem valor estratégico que vai além do balanço financeiro trimestral.

O impacto dos TPUs no custo operacional é mensurável: a empresa reportou uma redução de aproximadamente 78% no custo unitário de servir consultas ao Gemini ao longo de 2025, fruto das otimizações combinadas de hardware e software.

A IA em escala exige energia em escala. O Google anunciou parcerias com empresas de energia, como a NextEra Energy, para desenvolver campi de data centers alimentados por fontes renováveis capazes de fornecer gigawatts de capacidade. A empresa projetou dobrar sua capacidade física energizada até o final de 2026.

O gargalo da IA deixou de ser apenas o modelo ou o chip — é a disponibilidade de eletricidade limpa e confiável próxima a infraestrutura de rede de alta capacidade. O Google está comprando terrenos, fazendo lobby por aprovações de subestações elétricas e assinando contratos de energia de longo prazo em múltiplos continentes. A competição pela IA está literalmente remodelando a geopolítica energética global.

Para usuários individuais, o Google opera em modelo freemium. Versões básicas do Gemini são acessíveis gratuitamente, enquanto o Gemini Advanced — incluído no Google One AI Premium, com preço em torno de US$ 20 por mês para usuários individuais — oferece acesso aos modelos mais poderosos, maior limite de contexto, recursos de Deep Research e integração avançada com Workspace.

A estratégia de oferecer um mês gratuito de trial do Gemini Advanced é clássica no playbook de conversão de produtos SaaS: reduz a barreira de adoção e cria dependência de fluxo de trabalho antes de cobrar.

Para desenvolvedores, a monetização principal ocorre por meio do Google AI Studio e do Vertex AI, com precificação por tokens consumidos — tanto no input (o que o modelo recebe) quanto no output (o que o modelo gera). O Gemini 2.5 Pro, por exemplo, é precificado por milhão de tokens, com taxas diferenciadas por volume.

O Google Cloud, que cresceu 34% ano a ano no terceiro trimestre de 2025 e atingiu US$ 15,2 bilhões em receita trimestral, é o principal veículo de monetização enterprise. Com US$ 240 bilhões em backlog de contratos ao final de 2025 — o que representa demanda comprometida pelos próximos anos — a empresa tem visibilidade de receita que justifica a agressividade do investimento em infraestrutura.

Cerca de 75% dos clientes de Cloud já usam soluções de IA verticais, desde TPUs customizados até a plataforma Vertex AI — um indicador de adoção profunda que cria dependência e barreiras de saída.

A publicidade continua sendo o maior negócio da Alphabet. A IA está sendo integrada em todos os seus pontos — desde a geração automática de anúncios mais eficazes até a personalização de campanhas com base em sinais contextuais mais ricos. O AI Mode no Search redefine a relação entre pesquisa e publicidade: o desafio é monetizar respostas diretas da IA sem destruir o modelo de links patrocinados que gerou mais de US$ 200 bilhões em receita de advertising em 2025.

O Universal Commerce Protocol (UCP), lançado em início de 2026, já permite que usuários nos EUA naveguem por produtos e completem compras diretamente dentro do Gemini — abrindo uma nova camada de comércio eletrônico que concorre diretamente com o checkout do ChatGPT e com a Amazon.

A guerra da inteligência artificial tem uma dimensão que extrapola completamente a disputa comercial entre Silicon Valley e seus concorrentes. IA é hoje explicitamente tratada como questão de segurança nacional pelos governos dos Estados Unidos e da China.

Do lado americano, controles de exportação sobre chips avançados de IA — que afetam GPUs da NVIDIA e outros semicondutores — buscam retardar o avanço da China em capacidade de treinamento de modelos. O governo Biden estabeleceu restrições em 2023, que foram expandidas subsequentemente. A escolha de onde hospedar dados, quais modelos usar e quem fornece infraestrutura de IA passa a ter implicações de conformidade regulatória e alinhamento geopolítico que vão além da performance técnica.

O Google, como empresa americana com operações globais, navegou tensões complexas: ao mesmo tempo em que beneficia de controles que limitam concorrentes chineses como o Baidu e os modelos da DeepSeek, enfrenta pressões para manter presença em mercados onde restrições geopolíticas complicam o fornecimento de serviços.

O lançamento do DeepSeek R1, em janeiro de 2025, foi um momento de virada geopolítica disfarçado de notícia técnica. O modelo chinês demonstrou capacidade de raciocínio comparável a modelos americanos de ponta, mas com uma eficiência de treinamento dramaticamente superior — sugerindo que as restrições de acesso a chips avançados não eliminaram a competitividade da pesquisa em IA da China.

O DeepSeek provocou uma revisão em toda a indústria ocidental sobre a relação entre investimento em compute e avanço de capacidade dos modelos. Para o Google, foi também um lembrete de que a vantagem de escala de infraestrutura não é uma proteção absoluta contra inovação algorítmica disruptiva vinda de qualquer lugar do mundo.

A Europa abriu uma terceira frente: não de inovação, mas de regulação. O AI Act europeu, em vigência plena a partir de 2025, impõe requisitos de transparência, avaliação de risco e conformidade para sistemas de IA de alto impacto — e afeta diretamente como o Google pode operar, treinar modelos e usar dados de usuários europeus.

Para o Google, navegar o AI Act significa custos adicionais de compliance, limitações potenciais em certas funcionalidades de personalização e o risco de divergência entre o produto que oferece na Europa e o produto que oferece nos Estados Unidos — fragmentação regulatória que aumenta a complexidade operacional e o custo de manutenção de um ecossistema verdadeiramente global.

Ao mesmo tempo, a Europa tenta fomentar campeões locais de IA — com iniciativas como o apoio ao Mistral francês — como estratégia de reduzir dependência tecnológica de empresas americanas e chinesas. O Google tenta se posicionar como parceiro confiável nesse contexto, com comprometimentos de soberania de dados e parcerias com governos europeus.

Enquanto as grandes potências travam batalhas por regulação e supremacia tecnológica, a próxima onda de adoção de IA ocorrerá no Sul Global — Brasil, Índia, Indonésia, México, África Subsaariana. O Google está estrategicamente posicionado para esta expansão: Android domina o mercado de smartphones em economias emergentes, o YouTube é o veículo de consumo de vídeo na maioria desses países e o Google Translate já tem infraestrutura linguística em centenas de idiomas.

A questão é se o Google conseguirá adaptar seus modelos e ferramentas para contextos locais com a mesma efetividade que demonstrou em mercados ocidentais — ou se players locais e regionais, como a IA brasileira, a indiana ou a africana, construirão alternativas mais alinhadas com necessidades e culturas específicas.

A OpenAI continua sendo o principal termômetro de comparação para o Gemini. Com GPT-5 lançado em agosto de 2025 e uma rodada de captação de US$ 110 bilhões anunciada em fevereiro de 2026 a uma avaliação de US$ 730 bilhões, a empresa está em uma trajetória de crescimento que não dá sinais de desaceleração. O ChatGPT mantém a liderança em base de usuários ativos e em mindshare — a percepção popular de qual ferramenta de IA “funciona melhor”.

A vantagem do Google sobre a OpenAI: distribuição. O Google tem acesso nativo a bilhões de usuários através de Search, Android, Chrome, Gmail e YouTube. A OpenAI precisa construir distribuição do zero ou depender de parceiros como Microsoft. Em jogadas de longo prazo, a distribuição costuma vencer o produto isolado.

A Microsoft construiu uma posição formidável ao integrar IA em toda a suite Microsoft 365 — Word, Excel, PowerPoint, Teams, Outlook — sob a marca Copilot, alimentada pelos modelos da OpenAI. Para empresas com grande adoção de Microsoft 365, a barreira de adoção do Copilot é praticamente zero: a IA já está onde o trabalho acontece.

O Google enfrenta esse posicionamento com a integração do Gemini no Workspace — Gmail, Docs, Sheets, Slides, Meet. A batalha pelo mercado enterprise de produtividade é talvez o conflito mais diretamente comercial entre Google e Microsoft-OpenAI, e seu desfecho dependerá tanto de performance quanto de relacionamentos de vendas, contratos enterprise e inercia de adoção.

Uma das narrativas menos óbvias da guerra da IA é a posição da Anthropic — empresa fundada por ex-líderes do Google e da OpenAI, apoiada tanto pelo Google (com investimentos superiores a US$ 2 bilhões) quanto pela Amazon. O Claude, conforme pesquisa da Menlo Ventures com 150 decisores técnicos, capturou 32% dos workloads de IA em produção no ambiente enterprise americano em 2025 — à frente da OpenAI com 25% e do Google com 20%.

Em geração de código — possivelmente o caso de uso enterprise mais economicamente significativo — o Claude comanda 42% do mercado. É um número que revela uma dissonância importante: o Google tem mais distribuição e mais modelos, mas está perdendo a batalha de qualidade percebida em casos de uso críticos para o mercado enterprise.

A Meta joga um jogo diferente: ao abrir o Llama, cria um ecossistema onde qualquer empresa pode usar os modelos sem pagar à Meta — o que, paradoxalmente, beneficia a Meta ao estabelecer seus modelos como padrão de referência e ao alimentar o desenvolvimento de um ecossistema de ferramentas compatíveis. O Llama 4, lançado em 2025, competiu diretamente com o Gemma do Google pelo mercado open source.

A aposta da Meta no open source cria pressão constante sobre a disposição de empresas para pagar por APIs proprietárias: se um modelo aberto de qualidade comparável está disponível para rodar localmente, o argumento de custo-benefício para usar APIs pagas precisa ser mais forte do que nunca.

O Departamento de Justiça americano ganhou uma ação antitruste histórica contra o Google em 2024, e as consequências regulatórias continuaram se desenrolando em 2025 e 2026. Embora o risco de um desmembramento forçado de Chrome ou Android tenha sido evitado, novas obrigações de compartilhamento de dados foram impostas — obrigações que podem enfraquecer, em certa medida, o fosso competitivo que o Google construiu ao longo de décadas de dominância em busca.

A ironia geopolítica: no momento em que os Estados Unidos precisam de campeões tecnológicos fortes para competir com a China em IA, a regulação antitruste doméstica está adicionando fricção ao crescimento do principal contendor americano no espaço.

O Google tem histórico misto na execução de produtos de consumo fora do seu núcleo de busca e publicidade. O Google+ falhou. O Google Stadia foi descontinuado. O Bard teve um lançamento embaraçoso com erros factuais que custaram bilhões em valor de mercado em uma única tarde. A pergunta não é se o Google tem a tecnologia — é se tem a disciplina de produto e a velocidade de iteração para competir com a velocidade de lançamento da OpenAI.

Todos os grandes modelos de linguagem ainda cometem erros factuais — as chamadas “alucinações”. No contexto de um produto como o Google Search, onde bilhões de pessoas buscam informação sobre saúde, finanças, medicina e questões jurídicas, alucinações têm consequências reais. A integração acelerada de IA na busca amplia o alcance potencial de informações incorretas em escala que nenhum erro de algoritmo anterior chegou perto de atingir.

O Google investe pesadamente em sistemas de verificação e grounding — ancorar respostas em fontes verificáveis — mas o problema não está resolvido para nenhum player do mercado. É um risco sistêmico que acompanhará a indústria por anos.

Para entender a amplitude da ambição do Google com seu ecossistema de IA, é útil olhar para analogias históricas. O Windows da Microsoft, nos anos 90, não ganhou a corrida dos sistemas operacionais apenas por ser o melhor sistema operacional — ganhou porque criou o ecossistema de desenvolvedores mais rico, com mais aplicativos, mais integração de hardware e mais efeitos de rede. O Android repetiu a fórmula no mobile: ao distribuir gratuitamente e construir um ecossistema de aplicativos, dominou o mercado global de smartphones mesmo sem ser tecnicamente o sistema mais refinado disponível.

O Google está tentando construir o equivalente para a era da IA: uma plataforma onde modelos (Gemini), ferramentas (Veo, NotebookLM, Stitch), protocolos (A2A, ADK), infraestrutura (TPUs, Google Cloud) e aplicações (Search, Workspace, YouTube) formem um conjunto integrado tão coeso e tão abrangente que substituí-lo seja tecnicamente inviável e economicamente proibitivo.

O Google está tentando construir o sistema operacional da inteligência artificial? A resposta mais honesta é: sim — e está mais perto de conseguir do que a maioria das análises superficiais sugere.

Com US$ 175 bilhões a US$ 185 bilhões em capex projetados para 2026, com US$ 240 bilhões em backlog de contratos Cloud, com Gemini integrado em produtos que tocam mais de 4 bilhões de usuários mensais, com TPUs próprios que reduzem dependência de fornecedores externos, com protocolos de agentes que podem se tornar padrão da indústria e com uma rede de distribuição impossível de replicar em menos de uma década, o Google reuniu os ingredientes que historicamente definem quem controla a próxima plataforma tecnológica.

Mas a história de tecnologia é cheia de exemplos de quem tinha os ingredientes e não conseguiu assar o bolo: o Yahoo tinha o tráfego mas não construiu a busca. A Nokia tinha a distribuição mas não construiu o ecossistema de apps. A IBM tinha a infraestrutura mas cedeu o sistema operacional para a Microsoft.

O Google de 2026 tem escala, tecnologia, capital e distribuição. O que decidirá se transforma isso em dominância duradoura é a capacidade de executar com velocidade, de construir produtos que os usuários realmente amem usar — e de manter a confiança de desenvolvedores, empresas e governos num mundo onde a IA passou de ferramenta de produtividade para infraestrutura crítica de civilização.

Gemini é a família de modelos de inteligência artificial do Google, desenvolvida pelo Google DeepMind. Existe em múltiplas versões — Flash (velocidade), Pro (raciocínio avançado) e versões especializadas como Deep Research — e está integrado a produtos como Google Search, Gmail, Google Docs, YouTube e Google Cloud. É o equivalente do Google ao GPT da OpenAI e ao Claude da Anthropic.

Veo é o modelo de geração de vídeo do Google, capaz de criar clipes de vídeo realistas a partir de descrições em texto. Concorre diretamente com o Sora da OpenAI e com ferramentas como Runway e Pika. Na versão 3.1, apresentou avanços significativos em coerência visual e controle criativo. É estrategicamente integrado ao YouTube — a maior plataforma de vídeo do mundo.

NotebookLM é um assistente de pesquisa baseado em IA que permite ao usuário carregar seus próprios documentos e criar um assistente especializado naquele conteúdo específico. Em vez de responder com base em treinamento genérico, fundamenta todas as respostas nas fontes fornecidas, citando passagens e identificando conexões. É uma das ferramentas mais diferenciadas do portfólio Google para uso acadêmico e profissional.

Sim. O Google oferece o Google ADK (Agent Development Kit) para construção de agentes autônomos escaláveis, o protocolo A2A para comunicação entre agentes, e produtos como Jules (agente de programação) e Antigravity (agente de segurança). A camada de agentes é a aposta mais estratégica de longo prazo do ecossistema Google.

Para usuários individuais, as versões básicas do Gemini são gratuitas, com o Gemini Advanced disponível no plano Google One AI Premium por cerca de US$ 20/mês. Para desenvolvedores, os modelos são acessíveis via API com precificação por milhão de tokens. Para empresas, o Google Workspace com IA e os serviços do Google Cloud têm precificação corporativa a partir de US$ 30 por usuário/mês para planos Business.

Este artigo é uma análise editorial baseada em informações públicas disponíveis até março de 2026. Os valores de investimento e dados de mercado citados são provenientes de relatórios financeiros da Alphabet, declarações públicas de executivos e análises de mercado de terceiros.

Aprofunde seu entendimento sobre o ecossistema de IA do Google, investimentos em Gemini, Veo, NotebookLM e agentes autônomos com estas fontes confiáveis e atualizadas para 2026:

Se você se interessa por inteligência artificial, desenvolvimento de software e as transformações que a IA está provocando no mercado de tecnologia, confira também estas análises publicadas no SPTechBR.

Grandes modelos de linguagem podem gerar respostas extremamente convincentes — mesmo quando estão erradas. Neste artigo, explicamos por que surgem as chamadas alucinações de IA, como esse fenômeno acontece dentro dos modelos e quais estratégias pesquisadores e empresas estão desenvolvendo para reduzir esse problema.

Ferramentas de desenvolvimento com IA estão mudando a forma como programadores escrevem software. O Cursor AI integra modelos de linguagem diretamente ao editor de código, permitindo gerar, revisar e refatorar código com muito mais velocidade — uma mudança que pode transformar o fluxo de trabalho da engenharia de software.

Uma nova abordagem de desenvolvimento está surgindo: em vez de escrever cada linha manualmente, desenvolvedores passam a orquestrar inteligência artificial para construir aplicações. Entenda o conceito de vibe coding e por que ele pode redefinir a maneira como produtos digitais são criados.