Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Se você acompanhou o lançamento do ChatGPT em novembro de 2022, lembra do espanto coletivo. Em três meses, a ferramenta alcançou 100 milhões de usuários — o produto de tecnologia de adoção mais rápida da história até aquele momento. Para muita gente, aquilo parecia uma anomalia, um pico de curiosidade que logo esfriaria.

Não esfriou.

Em 2026, o mercado global de IA generativa está avaliado em aproximadamente $67 bilhões, com projeção de ultrapassar $200 bilhões até 2030, segundo dados da Grand View Research. Mais relevante do que o número em si é o que ele representa em termos comportamentais: segundo a McKinsey Global Survey de 2025, 78% das organizações globais afirmam usar IA generativa em pelo menos uma função de negócio — em 2023, esse número era 33%. A adoção não apenas cresceu; ela se normalizou.

O perfil de quem usa essas ferramentas também mudou. Não se trata mais de desenvolvedores early adopters ou pesquisadores. A base de usuários hoje inclui advogados gerando minutas contratuais, médicos organizando prontuários, professores criando materiais didáticos personalizados, analistas financeiros automatizando relatórios, e designers produzindo variações criativas em escala. A curva de aprendizado comprimiu, as interfaces ficaram mais acessíveis, e a pergunta que domina o cenário agora não é mais “isso funciona?” — é “qual ferramenta usar para este problema específico?”.

É exatamente essa pergunta que este artigo responde. Não com uma lista rasa de nomes e logos, mas com uma análise real do que cada categoria entrega, onde cada ferramenta se destaca, onde falha, e qual é a estratégia de adoção mais inteligente para diferentes perfis profissionais.

Antes de entrar no comparativo, vale nomear um problema estrutural que afeta a maioria das avaliações de ferramentas de IA publicadas na internet: elas são escritas com base em demonstrações, não em uso real.

Um modelo de IA parece impressionante quando o avaliador escolhe os prompts certos, usa os exemplos mais favoráveis e compara com alternativas em condições ideais. Isso é marketing, não análise.

A realidade de quem usa essas ferramentas no dia a dia é diferente: existem falhas de consistência, alucinações em tarefas que parecem simples, limitações de contexto que se tornam evidentes em projetos longos, e custos que escalam de forma não linear quando você aumenta o volume de uso.

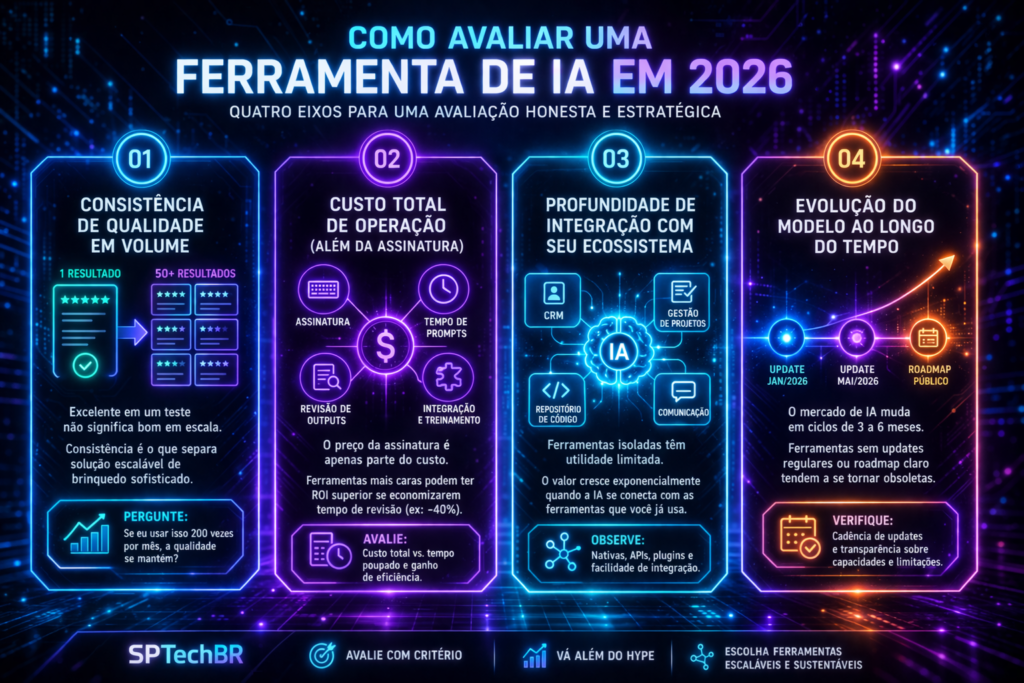

A forma mais honesta de avaliar uma ferramenta de IA passa por quatro eixos:

Uma ferramenta que gera um resultado excelente em uma tentativa pode ser medíocre quando você precisa de cinquenta. A consistência é o que diferencia uma solução escalável de um brinquedo sofisticado. Pergunte: se eu usar isso 200 vezes por mês, a qualidade se mantém?

O preço da assinatura é apenas parte do custo. Existe o tempo gasto para escrever bons prompts, revisar outputs, integrar a ferramenta ao fluxo existente e treinar a equipe. Uma ferramenta mais cara pode ter ROI superior se reduzir o tempo de revisão em 40%.

Uma IA que funciona de forma isolada tem utilidade limitada. O valor cresce exponencialmente quando ela se conecta com as ferramentas que você já usa — CRM, gestão de projetos, repositório de código, plataformas de comunicação.

O mercado de IA muda em ciclos de 3 a 6 meses. Uma ferramenta que não atualiza seu modelo regularmente ou que não tem um roadmap claro tende a se tornar obsoleta rapidamente. Vale observar a cadência de updates e a transparência do desenvolvedor sobre capacidades e limitações.

Com esses critérios em mente, vamos à análise por categoria.

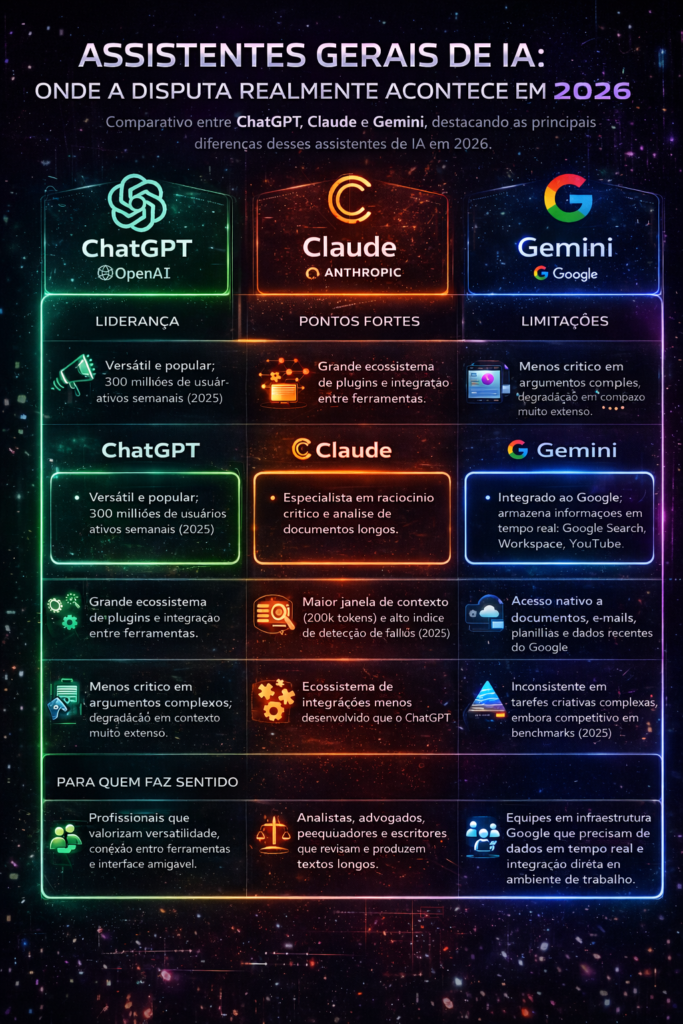

Esta é a categoria mais madura e mais disputada. ChatGPT, Claude e Gemini são frequentemente tratados como produtos intercambiáveis, mas as diferenças entre eles são substanciais — e ignorar essas diferenças significa usar a ferramenta errada para o problema certo.

O ChatGPT mantém a liderança em termos de base de usuários. A OpenAI divulgou em 2025 que a plataforma ultrapassa 300 milhões de usuários ativos semanais. Parte dessa vantagem é de distribuição — o ChatGPT foi o primeiro, construiu o maior ecossistema de plugins e integrações, e tem o reconhecimento de marca mais forte fora do ambiente técnico.

Em termos de capacidade, o GPT-4o e suas iterações mostram desempenho sólido em tarefas de raciocínio geral, geração de código, análise de dados (especialmente com o Advanced Data Analysis ativado) e multimodalidade — você pode enviar imagens, PDFs, planilhas e receber análises estruturadas.

O ponto de atenção: o ChatGPT tende a ser mais compliant do que crítico. Em benchmarks de raciocínio profundo e análise de argumentos complexos, modelos concorrentes apresentaram resultados superiores em 2025. Além disso, a janela de contexto, embora longa, ainda apresenta degradação de qualidade em conversas muito extensas — o modelo “esquece” nuances de instruções dadas no início da conversa.

Para quem faz sentido: profissionais que precisam de um assistente generalista, times com diferentes perfis que precisam de uma interface única, usuários que valorizam o ecossistema de plugins e a integração com outras ferramentas OpenAI.

O Claude se tornou a escolha preferida de escritores, analistas, advogados e pesquisadores que trabalham com documentos longos e exigem não apenas geração de texto, mas compreensão estruturada de argumentos. A janela de contexto de 200k tokens — equivalente a aproximadamente 150.000 palavras — é funcionalmente superior à maioria dos concorrentes para tarefas que envolvem ingestão de grandes volumes de texto.

O diferencial mais relevante do Claude não é técnico, é comportamental: o modelo é menos propenso a sycophancy — aquele comportamento irritante em que a IA concorda com tudo que você diz mesmo quando você está errado. Pesquisas independentes de 2025 indicaram que o Claude é o modelo que mais frequentemente aponta falhas em argumentos apresentados pelo usuário, o que o torna mais útil para revisão crítica de textos, análise jurídica e estruturação de estratégias de negócio.

O Claude também se destaca em tarefas de escrita de longa duração com consistência de voz — algo relevante para quem produz conteúdo editorial em escala. A tendência do modelo a manter coerência de estilo ao longo de documentos extensos é visivelmente superior ao que os concorrentes entregam na mesma condição.

Limitações reais: o Claude ainda tem um ecossistema de integrações menos desenvolvido que o ChatGPT. A interface, especialmente para usuários menos técnicos, pode parecer menos “amigável” em alguns fluxos.

Para quem faz sentido: advogados, analistas, jornalistas, consultores, pesquisadores e qualquer profissional que trabalha com documentos densos e precisa de um interlocutor que pensa — não apenas que escreve.

O Gemini tem uma vantagem estrutural que os concorrentes não conseguem replicar facilmente: integração nativa com o ecossistema Google. Isso significa acesso ao Google Search, Google Workspace (Docs, Sheets, Gmail), YouTube e, crucialmente, dados mais recentes do que qualquer modelo treinado com cortes de conhecimento estáticos.

Para profissionais que vivem dentro do Google Workspace — especialmente em empresas que usam Google para e-mail, documentos e reuniões — o Gemini representa um salto de produtividade real. A capacidade de resumir e-mails, rascunhar respostas com contexto de threads anteriores, analisar planilhas e gerar apresentações diretamente no ambiente que você já usa é genuinamente diferente de copiar e colar entre ferramentas.

O Gemini Advanced, integrado ao plano Google One AI Premium, tem mostrado capacidade de raciocínio comparável ao GPT-4o em benchmarks de 2025, embora ainda apresente inconsistências em tarefas criativas complexas.

Para quem faz sentido: equipes com infraestrutura Google consolidada, profissionais que precisam de informações atualizadas em tempo real, pesquisadores que trabalham com dados do Google Search.

A criação de imagens por IA passou por uma evolução técnica acelerada. Em 2023, os outputs tinham artefatos visuais evidentes — dedos errados, texto ilegível, proporções distorcidas. Em 2026, o nível de fidelidade atingido pelos melhores modelos é suficiente para uso comercial em boa parte dos casos de uso de marketing e comunicação.

O Midjourney mantém uma posição única no mercado: é o modelo que mais consistentemente entrega imagens com valor estético percebido. Não é necessariamente o mais fiel a prompts técnicos detalhados, mas é o que produz os resultados mais esteticamente satisfatórios para criação artística, branding e conteúdo editorial.

A versão 7 introduziu melhorias relevantes em coerência de personagens — um dos principais gargalos das versões anteriores — e na capacidade de seguir style references com maior fidelidade. O sistema de “character reference” permite que você defina um personagem visual e o mantenha consistente ao longo de diferentes cenas, o que abriu espaço para usos em narrativas visuais, livros infantis e conteúdo seriado.

Um dado relevante: uma pesquisa da Deloitte de 2025 indicou que 47% dos times de marketing B2B usam ferramentas de geração de imagem por IA para pelo menos uma etapa do processo criativo. O Midjourney é citado como ferramenta primária por 60% desse grupo.

Limitação importante: o Midjourney ainda opera via Discord (com interface web complementar) e não tem API pública robusta, o que limita integração em fluxos de trabalho automatizados. Para uso em escala, isso é um gargalo real.

O DALL·E 3, integrado ao ChatGPT e disponível via API, tem uma vantagem clara em relação ao Midjourney: fidelidade ao prompt textual. Quando você precisa que uma imagem contenha um texto específico, siga uma composição descrita em detalhe ou respeite restrições de layout, o DALL·E 3 performa melhor.

Para equipes de marketing que precisam de variações de campanhas com consistência de mensagem, ou para designers que usam IA como acelerador de processo (geração de rascunhos, exploração de conceitos), a integração com a API OpenAI facilita a automação de workflows.

Uma das mudanças mais significativas de 2025 para 2026 foi a ascensão dos modelos de geração de imagem open-source, especialmente o Flux (Black Forest Labs) e suas variantes. Esses modelos, que podem ser rodados localmente ou em serviços de cloud como Replicate e fal.ai, chegaram a um nível de qualidade que compete diretamente com Midjourney em categorias específicas.

Para empresas que lidam com dados sensíveis ou que precisam de customização profunda (fine-tuning em estilo de marca, por exemplo), os modelos open-source oferecem controle e privacidade que os serviços fechados não conseguem garantir. O custo de operação, para volumes altos, também é significativamente menor.

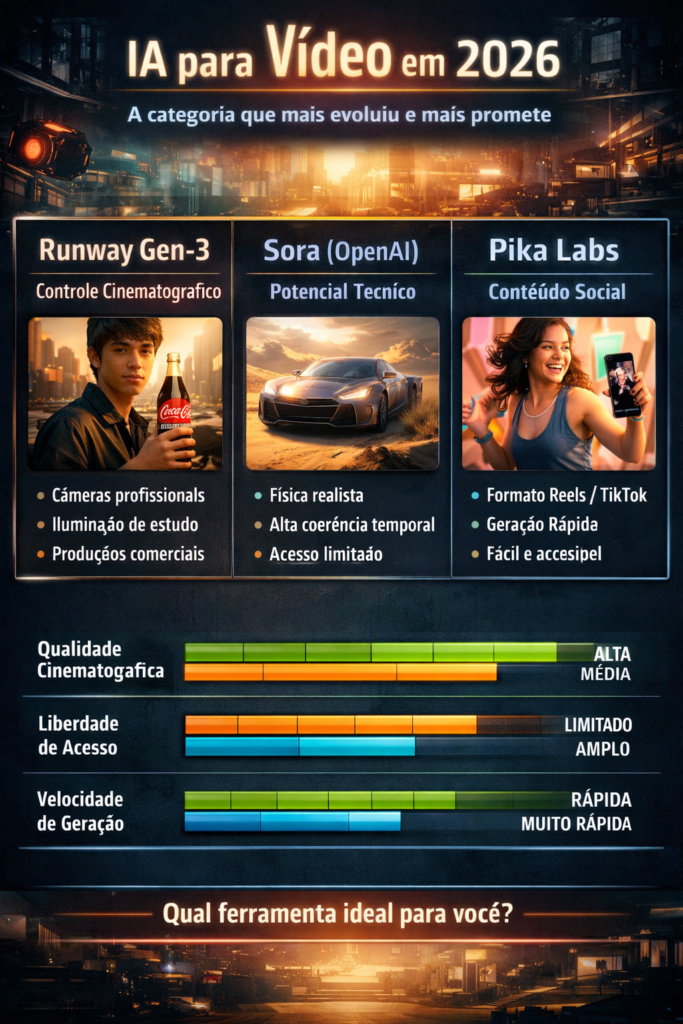

Se existe uma categoria onde a evolução de 2024 para 2026 foi mais dramática, é a de geração de vídeo. Os outputs de 2023 eram reconhecíveis como IA a olho nu — movimento não natural, inconsistência visual entre frames, qualidade de baixa resolução. O que as ferramentas atuais entregam é categoricamente diferente.

O Runway Gen-3 Alpha se tornou a ferramenta de referência para cineastas, criadores de conteúdo e equipes de marketing de alto padrão. A capacidade de controlar câmera (movimento, ângulo, distância focal), iluminação e consistência de personagens atingiu um nível que torna o Runway utilizável em produções comerciais reais — não apenas em provas de conceito.

Uma campanha da Coca-Cola criada com Runway em 2025 gerou cobertura significativa na imprensa especializada — não pela polêmica, mas pela qualidade. Agências de publicidade de médio porte começaram a usar Runway como substituto para produções de menor escala, com redução de custo de 60 a 80% em relação a produções tradicionais, segundo relatos do setor.

Limitação atual: o Runway ainda apresenta inconsistência em geração de rostos humanos em close, e o tempo de geração por clipe (entre 30 segundos e 3 minutos para clipes de 10 segundos) ainda é um gargalo para workflows de alta frequência.

O Sora, da OpenAI, demonstrou capacidade técnica superior ao Runway em benchmarks de qualidade e física de simulação. A coerência temporal — como o modelo mantém a física do mundo ao longo do vídeo — é notavelmente melhor. No entanto, o acesso ainda era restrito a planos premium e com limitações de uso em 2026.

Para profissionais que precisam de acesso regular e previsível, o Runway ainda é a escolha mais prática.

O Pika se posicionou como a ferramenta de geração de vídeo mais acessível para criadores de conteúdo de redes sociais. Interface simples, tempo de geração rápido e foco em formatos verticais (Reels, TikTok, Shorts) fizeram do Pika uma escolha natural para marketing de conteúdo de alta frequência.

Não é a ferramenta para quem busca qualidade cinematográfica, mas é eficiente para quem precisa de volume com qualidade suficiente para plataformas de redes sociais.

Esta categoria é, provavelmente, onde o retorno sobre investimento em IA é mais facilmente mensurável — e mais frequentemente mal implementado.

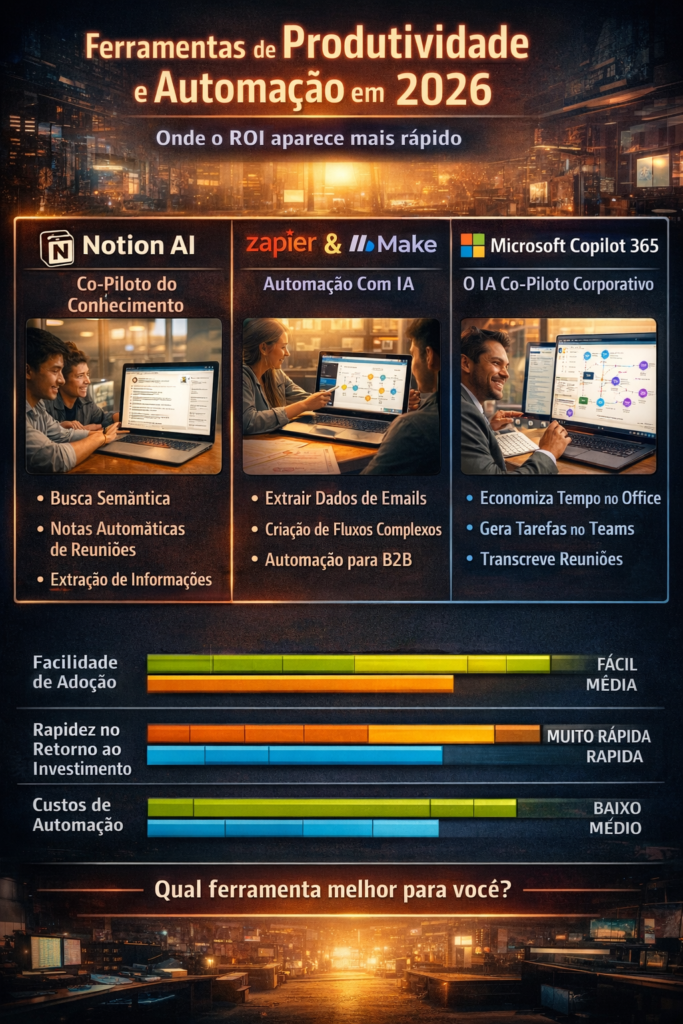

O Notion AI transformou o que era um app de notas e wikis em uma camada de inteligência sobre o conhecimento organizacional. A capacidade de busca semântica — encontrar informações por significado, não apenas por palavra-chave — é o diferencial mais subestimado da ferramenta.

Para times que documentam processos, projetos e decisões no Notion, o AI representa a diferença entre ter um repositório de conhecimento que ninguém consulta e ter um assistente que sintetiza o que a organização já sabe. Isso é especialmente relevante em empresas com alta rotatividade, onde a perda de contexto histórico é um problema real.

A funcionalidade de “AI meeting notes” — que transcreve, estrutura e distribui atas de reunião automaticamente — foi reportada como economizando entre 2 e 4 horas semanais por colaborador em times de produto, segundo dados da própria Notion coletados em 2025.

A adição de componentes de IA ao Zapier e ao Make mudou a natureza dessas ferramentas. Antes, elas eram “conectores” — você definia exatamente o que acontecia quando um evento ocorria. Agora, com IA no meio do fluxo, você pode definir intenções e deixar o modelo interpretar e agir.

Um exemplo prático: em vez de criar um Zap que extrai campos específicos de um e-mail recebido, você pode instruir o Zapier para “entender o contexto do e-mail e criar uma tarefa no CRM com os campos relevantes”. A IA lida com a variabilidade de formato e linguagem — o que antes exigia lógica condicional complexa.

O Make (ex-Integromat) ganhou terreno especialmente em cenários B2B mais complexos, onde os fluxos têm múltiplas ramificações e exceções. A curva de aprendizado é mais íngreme, mas a flexibilidade é correspondentemente maior.

O alerta que precisa ser dito: automação com IA sem um processo bem definido não acelera o trabalho — amplifica a desorganização. Times que implementaram automações sem mapear previamente seus processos relatam inconsistências, duplicações e perda de rastreabilidade. A IA não conserta um processo ruim; ela o executa mais rápido.

Enquanto o debate no mundo dos usuários individuais gira em torno de ChatGPT vs Claude, no mundo corporativo a batalha mais relevante é o Microsoft Copilot 365. Integrado ao Word, Excel, PowerPoint, Teams, Outlook e SharePoint, o Copilot representa a aposta da Microsoft em se tornar a camada de IA do trabalho corporativo.

Os resultados preliminares são relevantes: uma pesquisa da Microsoft com usuários de Copilot 365 em 2025 indicou que 68% reportaram economia de pelo menos uma hora por dia em tarefas administrativas. Usuários do Copilot no Teams relataram reuniões 30% mais curtas, com notas automáticas e action items gerados ao final de cada chamada.

O Copilot não é a ferramenta mais “impressionante” em demonstrações isoladas. Mas para organizações já dentro do ecossistema Microsoft, a integração nativa elimina a fricção de adoção que é o principal gargalo de qualquer nova tecnologia corporativa.

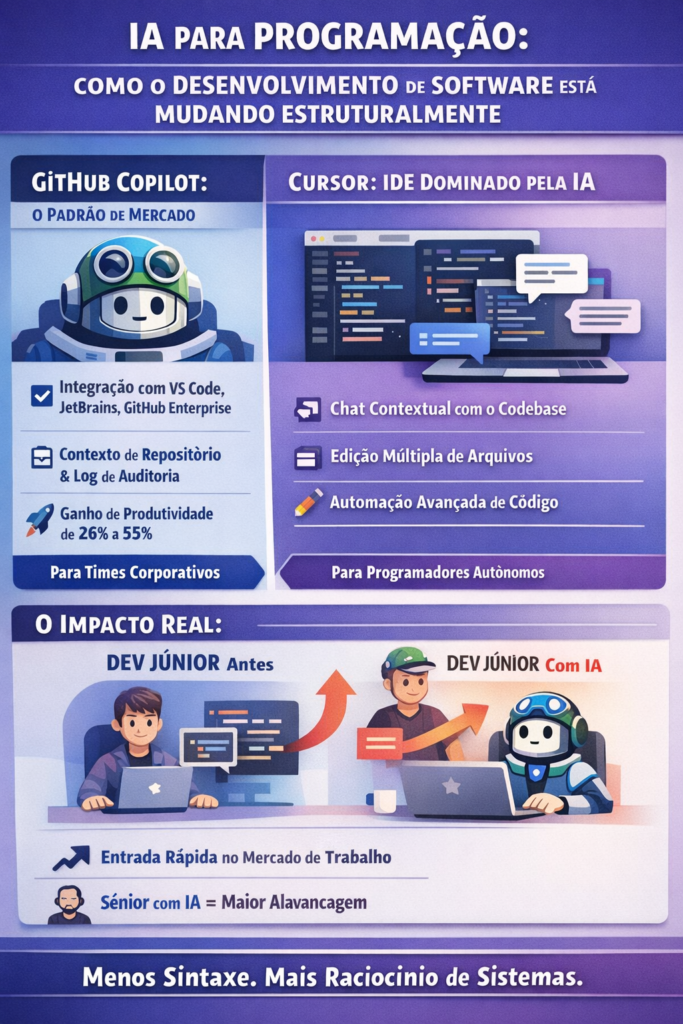

A adoção de IA no desenvolvimento de software é, de longe, a mais madura entre todas as categorias profissionais. Uma pesquisa do Stack Overflow de 2025 indicou que 82% dos desenvolvedores usam alguma ferramenta de IA no trabalho — e 62% usam diariamente.

O GitHub Copilot foi o primeiro produto de assistência de código a atingir adoção em massa, e mantém a posição de referência por uma razão simples: está onde os desenvolvedores já trabalham. A integração com VS Code, JetBrains, Vim e a interface web do GitHub elimina fricção de adoção.

O Copilot Business e o Copilot Enterprise adicionaram capacidades relevantes para times: contexto de repositório (o modelo entende o codebase específico da empresa, não apenas padrões genéricos), integração com issues e pull requests, e logs de auditoria para compliance.

Uma métrica frequentemente citada: desenvolvedores usando Copilot reportam aceitar sugestões em 30 a 35% das vezes — o que, para quem escreve código o dia todo, representa uma aceleração significativa. Um estudo da GitLab de 2025 estimou ganho de produtividade entre 26 e 55% dependendo da natureza da tarefa (maior em código boilerplate, menor em lógica de negócio complexa e nova).

O Cursor é, de longe, o produto de desenvolvimento mais discutido em comunidades técnicas em 2025 e 2026. Ele não é um plugin; é um IDE completo (baseado no VS Code) construído em torno da ideia de que IA deveria ser a interface primária, não um add-on.

O diferencial central do Cursor é a leitura de contexto do codebase: você pode referenciar arquivos, funções e símbolos diretamente no chat, e o modelo entende as dependências do seu projeto. Em vez de copiar e colar código em uma aba separada do ChatGPT, você tem uma conversa direta com um modelo que vê o que você vê.

O modo “Composer” do Cursor, que permite ao modelo editar múltiplos arquivos simultaneamente com base em uma instrução de alto nível (“adicione autenticação OAuth neste projeto e atualize todos os endpoints relevantes”), representa uma mudança qualitativa no que significa “assistência de código”. Você não está mais autocompleting linhas — está descrevendo intenções.

Para quem é: desenvolvedores que trabalham em projetos próprios ou com autonomia para escolher ferramentas. Em ambientes corporativos com restrições de segurança ou com stacks específicos que o Cursor não suporta bem, o Copilot ainda é a escolha mais segura.

Essa discussão frequentemente perde o foco no que realmente está acontecendo. Nenhuma dessas ferramentas substitui um desenvolvedor sênior em tarefas de arquitetura, decisões de tradeoff, debugging de bugs não reproduzíveis ou liderança técnica. O que elas fazem é comprimir o tempo em tarefas de implementação.

A consequência prática: o nível mínimo de competência para entregar software funcional caiu. Um desenvolvedor júnior com bom domínio de Cursor ou Copilot consegue entregar código que antes exigia um pleno. E um desenvolvedor sênior que usa essas ferramentas efetivamente aumenta sua alavancagem — faz mais com o mesmo tempo.

O que está mudando, de fato, é a curva de valor: programar está se tornando menos sobre sintaxe e mais sobre raciocínio de sistemas. Quem entende o problema que precisa ser resolvido — e consegue traduzir isso em instruções claras para a IA — tem vantagem crescente.

Uma categoria que ganhou relevância substancial em 2025-2026 é a de pesquisa aumentada por IA. Perplexity, Claude e Gemini com busca integrada estão mudando a forma como profissionais de conhecimento — consultores, analistas, jornalistas, pesquisadores — buscam e sintetizam informações.

O Perplexity se posicionou como alternativa direta ao Google Search para consultas que requerem síntese de múltiplas fontes. Em vez de retornar dez links que você precisa abrir e ler individualmente, o Perplexity lê as fontes e entrega uma resposta estruturada com citações verificáveis.

Para pesquisa profissional — levantamento de mercado, pesquisa competitiva, revisão de literatura — o Perplexity representa uma mudança real de processo. Uma análise competitiva que levaria 3 horas de busca manual pode ser estruturada em 20 minutos com Perplexity como ponto de partida.

A ressalva necessária: o Perplexity não substitui leitura crítica de fontes primárias. Ele é excelente para orientação inicial e síntese de consenso, mas pode simplificar excessivamente debates técnicos ou suprimir perspectivas minoritárias que seriam relevantes em análises mais aprofundadas.

Existe um padrão de erro muito comum entre profissionais que começam a adotar IA: a tentação de testar tudo. Assinaturas empilhadas, ferramentas que se sobrepõem, interfaces que competem pela atenção. O resultado é fragmentação cognitiva e ROI diluído.

A abordagem mais inteligente é construir uma stack com três camadas:

Escolha um assistente de IA como seu “ponto de entrada” padrão — aquele que você abre primeiro quando tem uma tarefa cognitiva. Essa escolha deve ser baseada no seu perfil de trabalho predominante, não em benchmarks genéricos.

Se você passa a maior parte do tempo dentro do Google Workspace, o Gemini faz mais sentido. Se você trabalha com análise de documentos longos e redação crítica, o Claude provavelmente entrega mais. Se você precisa de ecossistema de plugins e fluxos de automação, o ChatGPT tem vantagem.

Não tente usar três assistentes em paralelo para “ter o melhor de cada um”. O custo cognitivo de alternar contexto entre ferramentas cancela boa parte do ganho de produtividade.

Dependendo do seu trabalho, adicione uma ou duas ferramentas especializadas que o assistente central não cobre bem. Para desenvolvedores: Cursor ou Copilot. Para criadores de conteúdo visual: Midjourney ou DALL·E. Para times de produto: Notion AI.

Automação com Zapier, Make ou similares deve ser a última camada — não a primeira. Só faz sentido automatizar um processo que você já executa manualmente de forma consistente e repetível. Automatizar prematuramente é uma forma cara de escalar um processo ruim.

Há evidências crescentes de que o uso intensivo de IA para escrita está associado à redução de fluência em escrita autônoma. Um estudo da Microsoft Research publicado em 2025 encontrou que profissionais que delegaram mais de 70% das suas tarefas de escrita para IA relataram dificuldade crescente em escrever sem assistência. O mecanismo é simples: habilidades que não são exercitadas atrofiam.

Isso não significa não usar IA para escrita — significa usar com consciência. A distinção entre “usar IA para acelerar o que eu sei fazer” e “usar IA porque não sei mais fazer” é importante.

Quando muitas pessoas usam o mesmo modelo para produzir conteúdo, o resultado tende à convergência estilística. Artigos de blog, e-mails corporativos e propostas comerciais escritas com auxílio de IA têm padrões reconhecíveis — e esse reconhecimento começa a trabalhar contra quem os produz.

A diferenciação humana — voz autêntica, perspectiva incomum, narrativa baseada em experiência real — se torna mais valiosa à medida que o volume de conteúdo gerado por IA cresce.

Este ponto é frequentemente negligenciado por profissionais individuais e perigosamente subestimado por empresas: o que você envia para modelos de IA pode, dependendo dos termos de serviço, ser usado para treinar versões futuras.

Para dados sensíveis — estratégias de negócio, informações de clientes, dados financeiros não públicos — é essencial ler os termos de privacidade da ferramenta antes de usar. Muitas ferramentas enterprise oferecem garantias de privacidade que as versões consumer não têm.

A fronteira mais relevante em 2026 não é a qualidade dos modelos de linguagem — é a capacidade dos agentes de IA de executar tarefas de múltiplos passos de forma autônoma. Ferramentas como o Operator da OpenAI e o Computer Use da Anthropic estão testando a capacidade de modelos de IA navegarem interfaces de software, preencherem formulários e executarem fluxos de trabalho sem intervenção humana em cada etapa.

Isso não é ficção científica: já existe em estado beta para casos de uso específicos. A questão não é “vai acontecer?” — é “em que velocidade vai se generalizar?”. As estimativas mais cuidadosas apontam para adoção em nível corporativo entre 2026 e 2028.

A corrida por modelos cada vez maiores está cedendo espaço para uma tendência mais pragmática: modelos menores e altamente especializados. Modelos de 7B e 13B parâmetros, fine-tuned para domínios específicos (medicina, direito, finanças, código), estão atingindo performance comparável a modelos muito maiores em suas áreas de especialização — com a vantagem de rodarem localmente, sem envio de dados para servidores externos.

Para empresas com exigências de compliance, essa é uma mudança estrutural importante.

A capacidade de entender e gerar texto, imagem, áudio e vídeo no mesmo modelo está se tornando padrão. Isso significa que a distinção entre “ferramenta de texto” e “ferramenta de imagem” vai se dissolver progressivamente. O assistente central do futuro próximo provavelmente lidará com todas essas modalidades de forma integrada.

Qual a diferença real entre usar o ChatGPT e o Claude para tarefas de análise de negócios? Em termos práticos, o Claude tende a ser mais criterioso e menos propenso a confirmar premissas equivocadas. Para análise crítica de argumentos, revisão de documentos estratégicos ou situações onde você quer um interlocutor que discorda quando faz sentido, o Claude performa melhor. Para brainstorming generativo e tarefas que se beneficiam de um assistente mais “cooperativo”, o ChatGPT tem vantagem.

Vale a pena investir em modelos fine-tuned para o setor específico da minha empresa? Para empresas com volume suficiente (acima de 50 usuários de IA), sim — especialmente em setores com terminologia técnica densa (saúde, direito, engenharia). O custo de fine-tuning caiu significativamente em 2025, e os ganhos em precisão para terminologia específica são mensuráveis.

Como calcular ROI real de ferramentas de IA para justificar investimento interno? O método mais confiável é medir antes e depois em tarefas específicas: tempo médio para escrever um relatório, tempo médio para análise de documento, tempo para gerar primeira versão de código. Evite métricas de “horas economizadas” estimadas — elas são facilmente questionadas. Prefira deltas mensuráveis em tarefas concretas.

IA para criação de conteúdo vai desvalorizar o trabalho de redatores e designers? Vai mudar o que é valorizado, não eliminar a demanda. Produção em volume de conteúdo padrão foi afetada — esse mercado se comprimiu. Mas criação com perspectiva própria, construção de narrativa de marca e estratégia de conteúdo de longo prazo continuam sendo trabalho fundamentalmente humano. O profissional de conteúdo que usa IA como alavanca — produzindo mais com a mesma qualidade — tem mais valor do que antes; o que usa como muleta tem menos.

Existe uma tendência natural de tratar a escolha de ferramentas de IA como uma questão de pesquisa de produto: compare features, leia reviews, teste o free trial, decida. Essa abordagem não é errada — mas é incompleta.

A diferença entre times que extraem valor real de ferramentas de IA e times que acumulam assinaturas sem resultado expressivo quase nunca está na ferramenta escolhida. Está na profundidade com que a ferramenta foi integrada ao processo de trabalho existente.

Isso exige algo que vai além de experimentação: exige um ciclo de aprendizado deliberado, onde você usa a ferramenta em contexto real, observa onde ela falha, ajusta a forma como você formula instruções, e revisita o fluxo periodicamente à medida que o modelo é atualizado.

As ferramentas de IA mais valiosas em 2026 não são as mais impressionantes em demos isoladas. São as que você consegue usar de forma consistente, integrada ao seu trabalho real, com clareza sobre o que delegar e o que manter como responsabilidade humana.

Dominar isso é a habilidade mais relevante do profissional de conhecimento na segunda metade dos anos 2020.

🎙️ Prefere consumir conteúdo em áudio ou vídeo?

Este artigo também foi transformado em episódios exclusivos para você acompanhar onde quiser:

▶️ YouTube — versão em vídeo

Assista à análise completa com explicações visuais, exemplos práticos e insights sobre como escolher as melhores ferramentas de IA em 2026.

🎧 Spotify — versão em podcast

Ouça o conteúdo no formato ideal para o dia a dia: no trânsito, na academia ou durante o trabalho.

💡 Dica SPTechBR: ouvir e ler o conteúdo em conjunto acelera o entendimento e ajuda a fixar conceitos mais complexos sobre IA e produtividade.

Essas referências foram selecionadas por relevância e atualidade; algumas estatísticas do artigo são aproximadas ou projetadas, mas as fontes confirmam tendências semelhantes. Use-as para aprofundar ou citar no seu conteúdo.

🤖 Perplexity AI em 2026: vale substituir parte do seu stack de IA por ele?

Entenda como o Perplexity está mudando a forma de pesquisar com IA — e em quais cenários ele realmente pode substituir ferramentas tradicionais no seu fluxo de trabalho.

🧠 Abacus AI: review completo da plataforma que reúne mais de 40 modelos de IA

Uma análise prática de uma das plataformas mais completas do mercado — ideal para quem quer acessar múltiplos modelos de IA em um único ambiente.

🚀 A empresa de uma pessoa só: como a inteligência artificial está mudando o empreendedorismo para sempre

Descubra como a IA está permitindo que profissionais criem negócios altamente eficientes com equipes mínimas — e o impacto disso no futuro do trabalho.